diff --git a/DB.md b/DB.md

index 9292e64..7fd57da 100644

--- a/DB.md

+++ b/DB.md

@@ -264,7 +264,7 @@ SHOW PROCESSLIST:查看当前 MySQL 在进行的线程,可以实时地查看

1. 客户端发送一条查询给服务器

2. 服务器先会检查查询缓存,如果命中了缓存,则立即返回存储在缓存中的结果(一般是 K-V 键值对),否则进入下一阶段

3. 分析器进行 SQL 分析,再由优化器生成对应的执行计划

-4. MySQL 根据优化器生成的执行计划,调用存储引擎的 API 来执行查询

+4. 执行器根据优化器生成的执行计划,调用存储引擎的 API 来执行查询

5. 将结果返回给客户端

大多数情况下不建议使用查询缓存,因为查询缓存往往弊大于利

@@ -434,7 +434,7 @@ MySQL 中保存着两种统计数据:

* innodb_table_stats 存储了表的统计数据,每一条记录对应着一个表的统计数据

* innodb_index_stats 存储了索引的统计数据,每一条记录对应着一个索引的一个统计项的数据

-MySQL 在真正执行语句之前,并不能精确地知道满足条件的记录有多少条,只能根据统计信息来估算记录,统计信息就是索引的区分度,一个索引上不同的值的个数(比如性别只能是男女,就是 2 ),称之为基数(cardinality),**基数越大说明区分度越好**

+MySQL 在真正执行语句之前,并不能精确地知道满足条件的记录有多少条,只能根据统计信息来估算记录,统计信息就是索引的区分度,一个索引上不同的值的个数(比如性别只能是男女,就是 2 ),称之为基数(cardinality),**基数越大说明区分度越好**

通过**采样统计**来获取基数,InnoDB 默认会选择 N 个数据页,统计这些页面上的不同值得到一个平均值,然后乘以这个索引的页面数,就得到了这个索引的基数

@@ -3577,7 +3577,7 @@ MySQL 支持的存储引擎:

MyISAM 存储引擎:

* 特点:不支持事务和外键,读取速度快,节约资源

-* 应用场景:查询和插入操作为主,只有很少更新和删除操作,并对事务的完整性、并发性要求不高

+* 应用场景:**适用于读多写少的场景**,对事务的完整性要求不高,比如一些数仓、离线数据、支付宝的年度总结之类的场景,业务进行只读操作,查询起来会更快

* 存储方式:

* 每个 MyISAM 在磁盘上存储成 3 个文件,其文件名都和表名相同,拓展名不同

* 表的定义保存在 .frm 文件,表数据保存在 .MYD (MYData) 文件中,索引保存在 .MYI (MYIndex) 文件中

@@ -3593,7 +3593,7 @@ InnoDB 存储引擎:(MySQL5.5 版本后默认的存储引擎)

MEMORY 存储引擎:

- 特点:每个 MEMORY 表实际对应一个磁盘文件 ,该文件中只存储表的结构,表数据保存在内存中,且默认**使用 HASH 索引**,所以数据默认就是无序的,但是在需要快速定位记录可以提供更快的访问,**服务一旦关闭,表中的数据就会丢失**,存储不安全

-- 应用场景:通常用于更新不太频繁的小表,用以快速得到访问结果,类似缓存

+- 应用场景:**缓存型存储引擎**,通常用于更新不太频繁的小表,用以快速得到访问结果

- 存储方式:表结构保存在 .frm 中

MERGE 存储引擎:

@@ -3642,14 +3642,10 @@ MERGE 存储引擎:

| 批量插入速度 | 高 | 低 | 高 |

| **外键** | **不支持** | **支持** | **不支持** |

-MyISAM 和 InnoDB 的区别?

+只读场景 MyISAM 比 InnoDB 更快:

-* 事务:InnoDB 支持事务,MyISAM 不支持事务

-* 外键:InnoDB 支持外键,MyISAM 不支持外键

-* 索引:InnoDB 是聚集(聚簇)索引,MyISAM 是非聚集(非聚簇)索引

-

-* 锁粒度:InnoDB 最小的锁粒度是行锁,MyISAM 最小的锁粒度是表锁

-* 存储结构:参考本节上半部分

+* 底层存储结构有差别,MyISAM 是非聚簇索引,叶子节点保存的是数据的具体地址,不用回表查询

+* InnoDB 每次查询需要维护 MVCC 版本状态,保证并发状态下的读写冲突问题

@@ -5041,7 +5037,7 @@ CREATE INDEX idx_seller_name_sta_addr ON tb_seller(name, status, address); # 联

* **字符串不加单引号**,造成索引失效:隐式类型转换,当字符串和数字比较时会**把字符串转化为数字**

- 在查询时,没有对字符串加单引号,查询优化器会调用 CAST 函数将 status 转换为 int 进行比较,造成索引失效

+ 没有对字符串加单引号,查询优化器会调用 CAST 函数将 status 转换为 int 进行比较,造成索引失效

```mysql

EXPLAIN SELECT * FROM tb_seller WHERE name='小米科技' AND status = 1;

@@ -5134,7 +5130,7 @@ CREATE INDEX idx_seller_name_sta_addr ON tb_seller(name, status, address); # 联

EXPLAIN SELECT * FROM tb_seller WHERE sellerId NOT IN ('alibaba','huawei');

```

-* [MySQL 实战 45 讲](https://time.geekbang.org/column/article/74687)该章节最后提出了一种场景,获取到数据以后 Server 层还会做判断

+* [MySQL 实战 45 讲](https://time.geekbang.org/column/article/74687)该章节最后提出了一种慢查询场景,获取到数据以后 Server 层还会做判断

@@ -5202,7 +5198,7 @@ SHOW GLOBAL STATUS LIKE 'Handler_read%';

##### 自增机制

-自增主键可以让主键索引尽量地保持递增顺序插入,避免了页分裂,因此索引更紧凑

+自增主键可以让主键索引尽量地保持在数据页中递增顺序插入,不自增需要寻找其他页插入,导致随机 IO 和页分裂的情况

表的结构定义存放在后缀名为.frm 的文件中,但是并不会保存自增值,不同的引擎对于自增值的保存策略不同:

@@ -5770,9 +5766,9 @@ Flush 链表是一个用来**存储脏页**的链表,对于已经修改过的

##### LRU 链表

-当 Buffer Pool 中没有空闲缓冲页时就需要淘汰掉最近最少使用的部分缓冲页,为了实现这个功能,MySQL 创建了一个 LRU 链表,当访问某个页时:

+Buffer Pool 需要保证缓存的命中率,所以 MySQL 创建了一个 LRU 链表,当访问某个页时:

-* 如果该页不在 Buffer Pool 中,把该页从磁盘加载进来后会将该缓冲页对应的控制块作为节点放入 **LRU 链表的头部**

+* 如果该页不在 Buffer Pool 中,把该页从磁盘加载进来后会将该缓冲页对应的控制块作为节点放入 **LRU 链表的头部**,保证热点数据在链表头

* 如果该页在 Buffer Pool 中,则直接把该页对应的控制块移动到 LRU 链表的头部,所以 LRU 链表尾部就是最近最少使用的缓冲页

MySQL 基于局部性原理提供了预读功能:

@@ -5780,7 +5776,7 @@ MySQL 基于局部性原理提供了预读功能:

* 线性预读:系统变量 `innodb_read_ahead_threshold`,如果顺序访问某个区(extent:16 KB 的页,连续 64 个形成一个区,一个区默认 1MB 大小)的页面数超过了该系统变量值,就会触发一次**异步读取**下一个区中全部的页面到 Buffer Pool 中

* 随机预读:如果某个区 13 个连续的页面都被加载到 Buffer Pool,无论这些页面是否是顺序读取,都会触发一次**异步读取**本区所有的其他页面到 Buffer Pool 中

-预读会造成加载太多用不到的数据页,造成那些使用**频率很高的数据页被挤到 LRU 链表尾部**,所以 InnoDB 将 LRU 链表分成两段:

+预读会造成加载太多用不到的数据页,造成那些使用频率很高的数据页被挤到 LRU 链表尾部,所以 InnoDB 将 LRU 链表分成两段,**冷热数据隔离**:

* 一部分存储使用频率很高的数据页,这部分链表也叫热数据,young 区,靠近链表头部的区域

* 一部分存储使用频率不高的冷数据,old 区,靠近链表尾部,默认占 37%,可以通过系统变量 `innodb_old_blocks_pct` 指定

@@ -5847,7 +5843,7 @@ MySQL 5.7.5 之前 `innodb_buffer_pool_size` 只支持在系统启动时修改

#### Change

-InnoDB 管理的 Buffer Pool 中有一块内存叫 Change Buffer 用来对**增删改操作**提供缓存,参数 `innodb_change_buffer_max_size ` 来动态设置,设置为 50 时表示 Change Buffer 的大小最多只能占用 Buffer Pool 的 50%

+InnoDB 管理的 Buffer Pool 中有一块内存叫 Change Buffer 用来对**增删改操作**提供缓存,可以通过参数来动态设置,设置为 50 时表示 Change Buffer 的大小最多占用 Buffer Pool 的 50%

* 唯一索引的更新不能使用 Change Buffer,需要将数据页读入内存,判断没有冲突在写入

* 普通索引可以使用 Change Buffer,**直接写入 Buffer 就结束**,不用校验唯一性

@@ -5904,7 +5900,7 @@ SHOW PROCESSLIST 获取线程信息后,处于 Sending to client 状态代表

read_rnd_buffer 是 MySQL 的随机读缓冲区,当按任意顺序读取记录行时将分配一个随机读取缓冲区,进行排序查询时,MySQL 会首先扫描一遍该缓冲,以避免磁盘搜索,提高查询速度,大小是由 read_rnd_buffer_size 参数控制的

-**Multi-Range Read 优化**,将随机 IO 转化为顺序 IO 以降低查询过程中 IO 开销,因为大多数的数据都是按照主键递增顺序插入得到,所以按照主键的递增顺序查询的话,对磁盘的读比较接近顺序读,能够提升读性能

+Multi-Range Read 优化,**将随机 IO 转化为顺序 IO** 以降低查询过程中 IO 开销,因为大多数的数据都是按照主键递增顺序插入得到,所以按照主键的递增顺序查询的话,对磁盘的读比较接近顺序读,能够提升读性能

二级索引为 a,聚簇索引为 id,优化回表流程:

@@ -6346,7 +6342,7 @@ InnoDB 存储引擎提供了两种事务日志:redo log(重做日志)和 u

* redo log 用于保证事务持久性

* undo log 用于保证事务原子性和隔离性

-undo log 属于逻辑日志,根据每行操作进行记录,记录了 SQL 执行相关的信息,用来回滚行记录到某个版本

+undo log 属于**逻辑日志**,根据每行操作进行记录,记录了 SQL 执行相关的信息,用来回滚行记录到某个版本

当事务对数据库进行修改时,InnoDB 会先记录对应的 undo log,如果事务执行失败或调用了 rollback 导致事务回滚,InnoDB 会根据 undo log 的内容**做与之前相反的操作**:

@@ -6430,7 +6426,7 @@ roll_pointer 是一个指针,**指向记录对应的 undo log 日志**,一

* 将旧纪录进行 delete mark,在更新语句提交后由 purge 线程移入垃圾链表

* 根据更新的各列的值创建一条新纪录,插入到聚簇索引中

-在对一条记录修改前会**将记录的隐藏列 trx_id 和 roll_pointer 的旧值记录到 undo log 对应的属性中**,这样当前记录的 roll_pointer 指向当前 undo log 记录,当前 undo log 记录的 roll_pointer 指向旧的 undo log 记录,**形成一个版本链**

+在对一条记录修改前会**将记录的隐藏列 trx_id 和 roll_pointer 的旧值记录到当前 undo log 对应的属性中**,这样当前记录的 roll_pointer 指向当前 undo log 记录,当前 undo log 记录的 roll_pointer 指向旧的 undo log 记录,**形成一个版本链**

UPDATE、DELETE 操作产生的 undo 日志会用于其他事务的 MVCC 操作,所以不能立即删除,INSERT 可以删除的原因是 MVCC 是对现有数据的快照

@@ -6553,7 +6549,7 @@ undo log 是逻辑日志,记录的是每个事务对数据执行的操作,

undo log 的作用:

* 保证事务进行 rollback 时的原子性和一致性,当事务进行回滚的时候可以用 undo log 的数据进行恢复

-* 用于 MVCC 快照读,通过读取 undo log 的历史版本数据可以实现不同事务版本号都拥有自己独立的快照数据版本

+* 用于 MVCC 快照读,通过读取 undo log 的历史版本数据可以实现不同事务版本号都拥有自己独立的快照数据

undo log 主要分为两种:

@@ -6741,15 +6737,15 @@ Buffer Pool 的使用提高了读写数据的效率,但是如果 MySQL 宕机

log buffer 被划分为若干 redo log block(块,类似数据页的概念),每个默认大小 512 字节,每个 block 由 12 字节的 log block head、496 字节的 log block body、4 字节的 log block trailer 组成

* 当数据修改时,先修改 Change Buffer 中的数据,然后在 redo log buffer 记录这次操作,写入 log buffer 的过程是**顺序写入**的(先写入前面的 block,写满后继续写下一个)

-* log buffer 中有一个指针 buf_free,来标识该位置之前都是填满的 block,该位置之后都是空闲区域(**碰撞指针**)

+* log buffer 中有一个指针 buf_free,来标识该位置之前都是填满的 block,该位置之后都是空闲区域

MySQL 规定对底层页面的一次原子访问称为一个 Mini-Transaction(MTR),比如在 B+ 树上插入一条数据就算一个 MTR

* 一个事务包含若干个 MTR,一个 MTR 对应一组若干条 redo log,一组 redo log 是不可分割的,在进行数据恢复时也把一组 redo log 当作一个不可分割的整体处理

-* 所以不是每生成一条 redo 日志就将其插入到 log buffer 中,而是一个 MTR 结束后**将一组 redo 日志写入 log buffer**

+* 不是每生成一条 redo 日志就将其插入到 log buffer 中,而是一个 MTR 结束后**将一组 redo 日志写入**

-InnoDB 的 redo log 是**固定大小**的,redo 日志在磁盘中以文件组的形式存储,同一组中的每个文件大小一样格式一样,

+InnoDB 的 redo log 是**固定大小**的,redo 日志在磁盘中以文件组的形式存储,同一组中的每个文件大小一样格式一样

* `innodb_log_group_home_dir` 代表磁盘存储 redo log 的文件目录,默认是当前数据目录

* `innodb_log_file_size` 代表文件大小,默认 48M,`innodb_log_files_in_group` 代表文件个数,默认 2 最大 100,所以日志的文件大小为 `innodb_log_file_size * innodb_log_files_in_group`

@@ -6766,10 +6762,10 @@ redo 日志文件也是由若干个 512 字节的 block 组成,日志文件的

##### 日志刷盘

-redo log 需要在事务提交时将日志写入磁盘,但是比将内存中的 Buffer Pool 修改的数据写入磁盘的速度快,原因:

+redo log 需要在事务提交时将日志写入磁盘,但是比 Buffer Pool 修改的数据写入磁盘的速度快,原因:

* 刷脏是随机 IO,因为每次修改的数据位置随机;redo log 和 binlog 都是**顺序写**,磁盘的顺序 IO 比随机 IO 速度要快

-* 刷脏是以数据页(Page)为单位的,一个页上的一个小修改都要整页写入;redo log 中只包含真正需要写入的部分,减少无效 IO

+* 刷脏是以数据页(Page)为单位的,一个页上的一个小修改都要整页写入;redo log 中只包含真正需要写入的部分,好几页的数据修改可能只记录在一个 redo log 页中,减少无效 IO

* **组提交机制**,可以大幅度降低磁盘的 IO 消耗

InnoDB 引擎会在适当的时候,把内存中 redo log buffer 持久化(fsync)到磁盘,具体的**刷盘策略**:

@@ -6780,7 +6776,6 @@ InnoDB 引擎会在适当的时候,把内存中 redo log buffer 持久化(fs

* 2:在事务提交时将缓冲区的 redo 日志异步写入到磁盘,不能保证提交时肯定会写入,只是有这个动作。日志已经在操作系统的缓存,如果操作系统没有宕机而 MySQL 宕机,也是可以恢复数据的

* 写入 redo log buffer 的日志超过了总容量的一半,就会将日志刷入到磁盘文件,这会影响执行效率,所以开发中应**避免大事务**

* 服务器关闭时

-* checkpoint 时(下小节详解)

* 并行的事务提交(组提交)时,会将将其他事务的 redo log 持久化到磁盘。假设事务 A 已经写入 redo log buffer 中,这时另外一个线程的事务 B 提交,如果 innodb_flush_log_at_trx_commit 设置的是 1,那么事务 B 要把 redo log buffer 里的日志全部持久化到磁盘,**因为多个事务共用一个 redo log buffer**,所以一次 fsync 可以刷盘多个事务的 redo log,提升了并发量

服务器启动后 redo 磁盘空间不变,所以 redo 磁盘中的日志文件是被**循环使用**的,采用循环写数据的方式,写完尾部重新写头部,所以要确保头部 log 对应的修改已经持久化到磁盘

@@ -6876,9 +6871,9 @@ binlog 为什么不支持崩溃恢复?

* 首先更新该记录对应的聚簇索引,更新聚簇索引记录时:

* 更新记录前向 undo 页面写 undo 日志,由于这是更改页面,所以需要记录一下相应的 redo 日志

- 注意:修改 undo页面也是在**修改页面**,事务凡是修改页面就需要先记录相应的 redo 日志

+ 注意:修改 undo 页面也是在**修改页面**,事务只要修改页面就需要先记录相应的 redo 日志

- * 然后**先记录对应的的 redo 日志**(等待 MTR 提交后写入 redo log buffer),**最后进行真正的更新记录**

+ * 然后**记录对应的 redo 日志**(等待 MTR 提交后写入 redo log buffer),**最后进行真正的更新记录**

* 更新其他的二级索引记录,不会再记录 undo log,只记录 redo log 到 buffer 中

@@ -6919,7 +6914,7 @@ update T set c=c+1 where ID=2;

* Prepare 阶段:存储引擎将该事务的 **redo 日志刷盘**,并且将本事务的状态设置为 PREPARE,代表执行完成随时可以提交事务

* Commit 阶段:先将事务执行过程中产生的 binlog 刷新到硬盘,再执行存储引擎的提交工作,引擎把 redo log 改成提交状态

-redo log 和 binlog 都可以用于表示事务的提交状态,而**两阶段提交就是让这两个状态保持逻辑上的一致**,也有利于主从复制,更好的保持主从数据的一致性

+存储引擎层的 redo log 和 server 层的 binlog 可以认为是一个分布式事务, 都可以用于表示事务的提交状态,而**两阶段提交就是让这两个状态保持逻辑上的一致**,也有利于主从复制,更好的保持主从数据的一致性

@@ -6931,7 +6926,7 @@ redo log 和 binlog 都可以用于表示事务的提交状态,而**两阶段

系统崩溃前没有提交的事务的 redo log 可能已经刷盘(定时线程或者 checkpoint),怎么处理崩溃恢复?

-工作流程:获取 undo 链表首节点页面的 undo segement header 中的 TRX_UNDO_STATE 属性,表示当前链表的事务属性,事务状态是活跃(未提交)的就全部回滚,如果是 PREPARE 状态,就需要根据 binlog 的状态进行判断:

+工作流程:获取 undo 链表首节点页面的 undo segement header 中的 TRX_UNDO_STATE 属性,表示当前链表的事务属性,**事务状态是活跃(未提交)的就全部回滚**,如果是 PREPARE 状态,就需要根据 binlog 的状态进行判断:

* 如果在时刻 A 发生了崩溃(crash),由于此时 binlog 还没完成,所以需要进行回滚

* 如果在时刻 B 发生了崩溃,redo log 和 binlog 有一个共**同的数据字段叫 XID**,崩溃恢复的时候,会按顺序扫描 redo log:

@@ -7406,7 +7401,7 @@ InnoDB 会对间隙(GAP)进行加锁,就是间隙锁 (RR 隔离级别下

InnoDB 加锁的基本单位是 next-key lock,该锁是行锁和 gap lock 的组合(X or S 锁),但是加锁过程是分为间隙锁和行锁两段执行

-* 可以**保护当前记录和前面的间隙**,遵循左开右闭原则,单纯的是间隙锁左开右开

+* 可以**保护当前记录和前面的间隙**,遵循左开右闭原则,单纯的间隙锁是左开右开

* 假设有 10、11、13,那么可能的间隙锁包括:(负无穷,10]、(10,11]、(11,13]、(13,正无穷)

几种索引的加锁情况:

@@ -7416,7 +7411,7 @@ InnoDB 加锁的基本单位是 next-key lock,该锁是行锁和 gap lock 的

* 范围查询无论是否是唯一索引,都需要访问到不满足条件的第一个值为止

* 对于联合索引且是唯一索引,如果 where 条件只包括联合索引的一部分,那么会加间隙锁

-间隙锁优点:RR 级别下间隙锁可以解决事务的一部分的**幻读问题**,通过对间隙加锁,可以防止读取过程中数据条目发生变化。一部分的意思是不会对全部间隙加锁,只能加锁一部分的间隙

+间隙锁优点:RR 级别下间隙锁可以**解决事务的一部分的幻读问题**,通过对间隙加锁,可以防止读取过程中数据条目发生变化。一部分的意思是不会对全部间隙加锁,只能加锁一部分的间隙

间隙锁危害:

@@ -7752,7 +7747,7 @@ MySQL 的主从之间维持了一个**长连接**。主库内部有一个线程

主从复制主要依赖的是 binlog,MySQL 默认是异步复制,需要三个线程:

-- binlog thread:在主库事务提交时,负责把数据变更记录在二进制日志文件 binlog 中,并通知 slave 有数据更新

+- binlog thread:在主库事务提交时,把数据变更记录在日志文件 binlog 中,并通知 slave 有数据更新

- I/O thread:负责从主服务器上**拉取二进制日志**,并将 binlog 日志内容依次写到 relay log 中转日志的最末端,并将新的 binlog 文件名和 offset 记录到 master-info 文件中,以便下一次读取日志时从指定 binlog 日志文件及位置开始读取新的 binlog 日志内容

- SQL thread:监测本地 relay log 中新增了日志内容,读取中继日志并重做其中的 SQL 语句,从库在 relay-log.info 中记录当前应用中继日志的文件名和位点以便下一次执行

@@ -7836,7 +7831,7 @@ coordinator 就是原来的 SQL Thread,并行复制中它不再直接更新数

* 线程分配完成并不是立即执行,为了防止造成更新覆盖,更新同一 DB 的两个事务必须被分发到同一个工作线程

* 同一个事务不能被拆开,必须放到同一个工作线程

-MySQL 5.6 版本的策略:每个线程对应一个 hash 表,用于保存当前这个线程的执行队列里的事务所涉及的表,hash 表的 key 是数据库 名,value 是一个数字,表示队列中有多少个事务修改这个库,适用于主库上有多个 DB 的情况

+MySQL 5.6 版本的策略:每个线程对应一个 hash 表,用于保存当前这个线程的执行队列里的事务所涉及的表,hash 表的 key 是数据库名,value 是一个数字,表示队列中有多少个事务修改这个库,适用于主库上有多个 DB 的情况

每个事务在分发的时候,跟线程的**冲突**(事务操作的是同一个库)关系包括以下三种情况:

@@ -7846,7 +7841,7 @@ MySQL 5.6 版本的策略:每个线程对应一个 hash 表,用于保存当

优缺点:

-* 构造 hash 值的时候很快,只需要库名,而且一个实例上 DB 数也不会很多,不会出现需要构造很多个项的情况

+* 构造 hash 值的时候很快,只需要库名,而且一个实例上 DB 数也不会很多,不会出现需要构造很多项的情况

* 不要求 binlog 的格式,statement 格式的 binlog 也可以很容易拿到库名(日志章节详解了 binlog)

* 主库上的表都放在同一个 DB 里面,这个策略就没有效果了;或者不同 DB 的热点不同,比如一个是业务逻辑库,一个是系统配置库,那也起不到并行的效果,需要**把相同热度的表均匀分到这些不同的 DB 中**,才可以使用这个策略

@@ -7977,7 +7972,7 @@ SELECT master_pos_wait(file, pos[, timeout]);

* 选定一个从库执行判断位点语句,如果返回值是 >=0 的正整数,说明从库已经同步完事务,可以在这个从库执行查询语句

* 如果出现其他情况,需要到主库执行查询语句

-注意:如果所有的从库都延迟超过 timeout 秒,查询压力就都跑到主库上,所以需要进行权衡

+注意:如果所有的从库都延迟超过 timeout 秒,查询压力就都跑到主库上,所以需要进行权衡

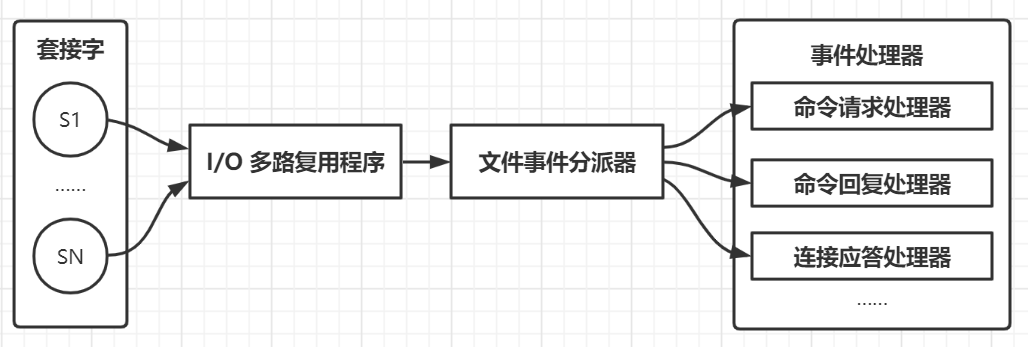

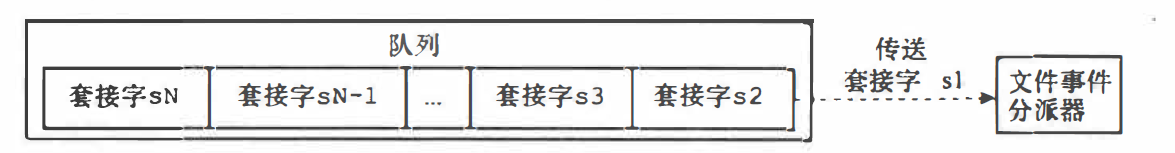

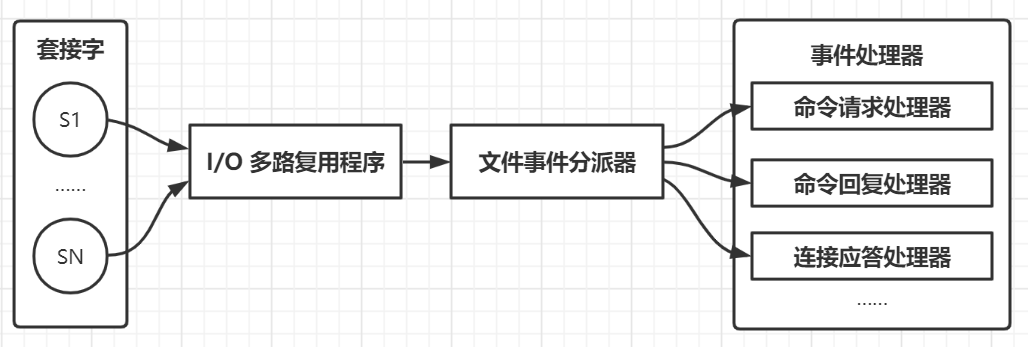

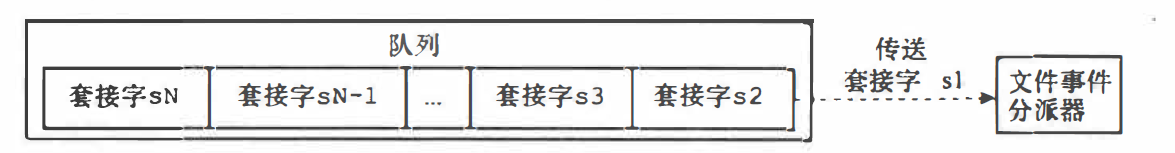

@@ -9721,7 +9716,7 @@ Redis 基于 Reactor 模式开发了网络事件处理器,这个处理器被

-尽管多个文件事件可能会并发出现,但是 I/O 多路复用程序将所有产生事件的套接字处理请求放入一个**单线程的执行队列**中,通过队列有序、同步的向文件事件分派器传送套接字,上一个套接字产生的事件处理完后,才会继续向分派器传送下一个

+I/O 多路复用程序将所有产生事件的套接字处理请求放入一个**单线程的执行队列**中,通过队列有序、同步的向文件事件分派器传送套接字,上一个套接字产生的事件处理完后,才会继续向分派器传送下一个

-尽管多个文件事件可能会并发出现,但是 I/O 多路复用程序将所有产生事件的套接字处理请求放入一个**单线程的执行队列**中,通过队列有序、同步的向文件事件分派器传送套接字,上一个套接字产生的事件处理完后,才会继续向分派器传送下一个

+I/O 多路复用程序将所有产生事件的套接字处理请求放入一个**单线程的执行队列**中,通过队列有序、同步的向文件事件分派器传送套接字,上一个套接字产生的事件处理完后,才会继续向分派器传送下一个

@@ -10799,7 +10794,7 @@ SDS 通过未使用空间解除了字符串长度和底层数组长度之间的

内存重分配涉及复杂的算法,需要执行**系统调用**,是一个比较耗时的操作,SDS 的两种优化策略:

-* 空间预分配:当 SDS需要进行空间扩展时,程序不仅会为 SDS 分配修改所必需的空间, 还会为 SDS 分配额外的未使用空间

+* 空间预分配:当 SDS 需要进行空间扩展时,程序不仅会为 SDS 分配修改所必需的空间, 还会为 SDS 分配额外的未使用空间

* 对 SDS 修改之后,SDS 的长度(len 属性)小于 1MB,程序分配和 len 属性同样大小的未使用空间,此时 len 和 free 相等

@@ -11010,7 +11005,7 @@ load_factor = ht[0].used / ht[0].size

原因:执行该命令的过程中,Redis 需要创建当前服务器进程的子进程,而大多数操作系统都采用写时复制(copy-on-write)技术来优化子进程的使用效率,通过提高执行扩展操作的负载因子,尽可能地避免在子进程存在期间进行哈希表扩展操作,可以避免不必要的内存写入操作,最大限度地节约内存

-哈希表执行收缩的条件:负载因子小于 0.1(自动执行,servreCron 中检测),缩小为字典中数据个数的 50% 左右

+哈希表执行收缩的条件:负载因子小于 0.1(自动执行,servreCron 中检测)

@@ -11553,7 +11548,7 @@ Redis 所有操作都是**原子性**的,采用**单线程**机制,命令是

-#### 对象

+#### 实现

字符串对象的编码可以是 int、raw、embstr 三种

@@ -12100,6 +12095,11 @@ set 类型:与 hash 存储结构哈希表完全相同,只是仅存储键不

当元素比较多时,此时 ziplist 的读写效率会下降,时间复杂度是 O(n),跳表的时间复杂度是 O(logn)

+为什么用跳表而不用平衡树?

+

+* 在做范围查找的时候,跳表操作简单(前进指针或后退指针),平衡树需要回旋查找

+* 跳表比平衡树实现简单,平衡树的插入和删除操作可能引发子树的旋转调整,而跳表的插入和删除只需要修改相邻节点的指针

+

***

@@ -12354,7 +12354,7 @@ AOF:将数据的操作过程进行保存,日志形式,存储操作过程

#### 文件创建

-RDB 持久化功能所生成的 RDB 文件 是一个经过压缩的紧凑二进制文件,通过该文件可以还原生成 RDB 文件时的数据库状态,有两个 Redis 命令可以生成 RDB 文件,一个是 SAVE,另一个是 BGSAVE

+RDB 持久化功能所生成的 RDB 文件是一个经过压缩的紧凑二进制文件,通过该文件可以还原生成 RDB 文件时的数据库状态,有两个 Redis 命令可以生成 RDB 文件,一个是 SAVE,另一个是 BGSAVE

@@ -12655,12 +12655,12 @@ appendfsync always|everysec|no #AOF写数据策略:默认为everysec

特点:安全性最高,数据零误差,但是性能较低,不建议使用

-- everysec:先将 aof_buf 缓冲区中的内容写入到 AOF 文件,判断上次同步 AOF 文件的时间距离现在超过一秒钟,再次对 AOF 文件进行同步 fsync,这个同步操作是由一个(子)线程专门负责执行的

+- everysec:先将 aof_buf 缓冲区中的内容写入到操作系统缓存,判断上次同步 AOF 文件的时间距离现在超过一秒钟,再次进行同步 fsync,这个同步操作是由一个(子)线程专门负责执行的

特点:在系统突然宕机的情况下丢失 1 秒内的数据,准确性较高,性能较高,建议使用,也是默认配置

-- no:将 aof_buf 缓冲区中的内容写入到 AOF 文件,但并不对 AOF 文件进行同步,何时同步由操作系统来决定

+- no:将 aof_buf 缓冲区中的内容写入到操作系统缓存,但并不进行同步,何时同步由操作系统来决定

特点:**整体不可控**,服务器宕机会丢失上次同步 AOF 后的所有写指令

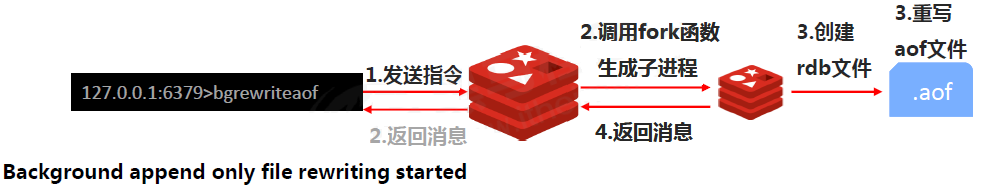

@@ -12758,7 +12758,7 @@ bgrewriteaof

* 子进程进行 AOF 重写期间,服务器进程(父进程)可以继续处理命令请求

-* 子进程带有服务器进程的数据副本,使用子进程而不是线程,可以在避免使用锁的情况下, 保证数据的安全性

+* 子进程带有服务器进程的数据副本,使用子进程而不是线程,可以在避免使用锁的情况下, 保证数据安全性

@@ -13495,7 +13495,7 @@ Redis 分布式锁的基本使用,悲观锁

`NX`:只在键不存在时,才对键进行设置操作,`SET key value NX` 效果等同于 `SETNX key value`

- `XX` :只在键已经存在时,才对键进行设置操作

+ `XX`:只在键已经存在时,才对键进行设置操作

`EX`:设置键 key 的过期时间,单位时秒

@@ -13633,7 +13633,7 @@ end

主从一致性:集群模式下,主从同步存在延迟,当加锁后主服务器宕机时,从服务器还没同步主服务器中的锁数据,此时从服务器升级为主服务器,其他线程又可以获取到锁

-将服务器升级为多主多从,:

+将服务器升级为多主多从:

* 获取锁需要从所有主服务器 SET 成功才算获取成功

* 某个 master 宕机,slave 还没有同步锁数据就升级为 master,其他线程尝试加锁会加锁失败,因为其他 master 上已经存在该锁

@@ -14007,7 +14007,7 @@ PSYNC 命令的调用方法有两种

#### 心跳机制

-心跳机制:进入命令传播阶段,从服务器默认会以每秒一次的频率,向主服务器发送命令:`REPLCONF ACK `,re_offset 是从服务器当前的复制偏移量

+心跳机制:进入命令传播阶段,**从服务器**默认会以每秒一次的频率,**向主服务器发送命令**:`REPLCONF ACK `,replication_offset 是从服务器当前的复制偏移量

心跳的作用:

@@ -14046,7 +14046,7 @@ slavel: ip=127.0.0.1,port=22222,state=online,offset=456,lag=3 # 3秒之前发送

#### 配置选项

-Redis 的 min-slaves-to-write 和 min-slaves-max-lag 两个选项可以防止主服务器在**不安全的情况下**执行写命令

+Redis 的 min-slaves-to-write 和 min-slaves-max-lag 两个选项可以防止主服务器在**不安全的情况下**拒绝执行写命令

比如向主服务器设置:

@@ -14113,7 +14113,7 @@ master 的 CPU 占用过高或 slave 频繁断开连接

* 出现的原因:

* slave 每 1 秒发送 REPLCONF ACK 命令到 master

- * 当 slave 接到了慢查询时(keys * ,hgetall等),会大量占用 CPU 性能

+ * 当 slave 接到了慢查询时(keys * ,hgetall 等),会大量占用 CPU 性能

* master 每 1 秒调用复制定时函数 replicationCron(),比对 slave 发现长时间没有进行响应

最终导致 master 各种资源(输出缓冲区、带宽、连接等)被严重占用

@@ -14277,7 +14277,7 @@ Sentinel 本质上只是一个运行在特殊模式下的 Redis 服务器,当

#### 代码替换

-将一部分普通 Redis服务器使用的代码替换成 Sentinel 专用代码

+将一部分普通 Redis 服务器使用的代码替换成 Sentinel 专用代码

Redis 服务器端口:

@@ -14321,7 +14321,7 @@ struct sentinelState {

// 当前纪元,用于实现故障转移

uint64_t current_epoch;

- // 保存了所有被这个sentinel监视的主服务器

+ // 【保存了所有被这个sentinel监视的主服务器】

dict *masters;

// 是否进入了 TILT 模式

@@ -14438,10 +14438,10 @@ typedef struct sentinelAddr {

##### 主服务器

-Sentinel 默认会以每十秒一次的频率,通过命令连接向被监视的主服务器发送 INFO 命令,来获取主服务器的当前信息

+Sentinel 默认会以每十秒一次的频率,通过命令连接向被监视的主服务器发送 INFO 命令,来获取主服务器的信息

* 一部分是主服务器本身的信息,包括 runid 域记录的服务器运行 ID,以及 role 域记录的服务器角色

-* 另一部分是服务器属下所有从服务器的信息,每个从服务器都由一个 slave 字符串开头的行记录,根据这些 IP 地址和端口号,Sentinel 无须用户提供从服务器的地址信息,就可以自动发现从服务器

+* 另一部分是服务器属下所有从服务器的信息,每个从服务器都由一个 slave 字符串开头的行记录,根据这些 IP 地址和端口号,Sentinel 无须用户提供从服务器的地址信息,就可以**自动发现从服务器**

```sh

# Server

@@ -14470,7 +14470,7 @@ slave1: ip=l27.0.0.1, port=22222, state=online, offset=22, lag=0

##### 从服务器

-当 Sentinel 发现主服务器有新的从服务器出现时,会为这个新的从服务器创建相应的实例结构,还会创建到从服务器的命令连接和订阅连接,所以 Sentinel 对所有的从服务器之间都可以进行命令操作

+当 Sentinel 发现主服务器有新的从服务器出现时,会为这个新的从服务器创建相应的实例结构,还会**创建到从服务器的命令连接和订阅连接**,所以 Sentinel 对所有的从服务器之间都可以进行命令操作

Sentinel 默认会以每十秒一次的频率,向从服务器发送 INFO 命令:

@@ -14614,7 +14614,7 @@ SENTINEL is-master-down-by-addr

源 Sentinel 将统计其他 Sentinel 同意主服务器已下线的数量,当这一数量达到配置指定的判断客观下线所需的数量(quorum)时,Sentinel 会将主服务器对应实例结构 flags 属性的 SRI_O_DOWN 标识打开,代表客观下线,并对主服务器执行故障转移操作

-注意:**不同 Sentinel 判断客观下线的条件可能不同**,因为载入的配置文件中的属性(quorum)可能不同

+注意:**不同 Sentinel 判断客观下线的条件可能不同**,因为载入的配置文件中的属性 quorum 可能不同

@@ -14624,7 +14624,7 @@ SENTINEL is-master-down-by-addr

### 领头选举

-主服务器被判断为客观下线时,监视这个主服务器的各个 Sentinel 会进行协商,选举出一个领头 Sentinel 对下线服务器执行故障转移

+主服务器被判断为客观下线时,**监视该主服务器的各个 Sentinel 会进行协商**,选举出一个领头 Sentinel 对下线服务器执行故障转移

Redis 选举领头 Sentinel 的规则:

@@ -14633,7 +14633,7 @@ Redis 选举领头 Sentinel 的规则:

* 在一个配置纪元里,所有 Sentinel 都只有一次将某个 Sentinel 设置为局部领头 Sentinel 的机会,并且局部领头一旦设置,在这个配置纪元里就不能再更改

* Sentinel 设置局部领头 Sentinel 的规则是先到先得,最先向目标 Sentinel 发送设置要求的源 Sentinel 将成为目标 Sentinel 的局部领头 Sentinel,之后接收到的所有设置要求都会被目标 Sentinel 拒绝

-* 领头 Sentinel 的产生需要半数以上 Sentinel 的支持,并且每个 Sentinel 只有一票,所以一个配置纪元只会出现一个领头 Sentinel,比如 10 个 Sentinel 的系统中,至少需要 `10/2 + 1 = 6` 票

+* 领头 Sentinel 的产生**需要半数以上 Sentinel 的支持**,并且每个 Sentinel 只有一票,所以一个配置纪元只会出现一个领头 Sentinel,比如 10 个 Sentinel 的系统中,至少需要 `10/2 + 1 = 6` 票

选举过程:

@@ -14641,7 +14641,7 @@ Redis 选举领头 Sentinel 的规则:

* 目标 Sentinel 接受命令处理完成后,将返回一条命令回复,回复中的 leader_runid 和 leader_epoch 参数分别记录了目标 Sentinel 的局部领头 Sentinel 的运行 ID 和配置纪元

* 源 Sentinel 接收目标 Sentinel 命令回复之后,会判断 leader_epoch 是否和自己的相同,相同就继续判断 leader_runid 是否和自己的运行 ID 一致,成立表示目标 Sentinel 将源 Sentinel 设置成了局部领头 Sentinel,即获得一票

* 如果某个 Sentinel 被半数以上的 Sentinel 设置成了局部领头 Sentinel,那么这个 Sentinel 成为领头 Sentinel

-* 如果在给定时限内,没有一个 Sentinel 被选举为领头 Sentinel,那么各个 Sentinel 将在一段时间后再次选举,直到选出领头

+* 如果在给定时限内,没有一个 Sentinel 被选举为领头 Sentinel,那么各个 Sentinel 将在一段时间后**再次选举**,直到选出领头

* 每次进行领头 Sentinel 选举之后,不论选举是否成功,所有 Sentinel 的配置纪元(configuration epoch)都要自增一次

Sentinel 集群至少 3 个节点的原因:

@@ -14649,7 +14649,10 @@ Sentinel 集群至少 3 个节点的原因:

* 如果 Sentinel 集群只有 2 个 Sentinel 节点,则领头选举需要 `2/2 + 1 = 2` 票,如果一个节点挂了,那就永远选不出领头

* Sentinel 集群允许 1 个 Sentinel 节点故障则需要 3 个节点的集群,允许 2 个节点故障则需要 5 个节点集群

+**如何获取哨兵节点的半数数量**?

+* 客观下线是通过配置文件获取的数量,达到 quorum 就客观下线

+* 哨兵数量是通过主节点是实例结构中,保存着监视该主节点的所有哨兵信息,从而获取得到

@@ -14748,7 +14751,8 @@ typedef struct clusterState {

// 集群当前的状态,是在线还是下线

int state;

- // 集群中至少处理着一个槽的节点的数量,为0表示集群目前没有任何节点在处理槽

+ // 集群中至少处理着一个槽的(主)节点的数量,为0表示集群目前没有任何节点在处理槽

+ // 【选举时投票数量超过半数,从这里获取的】

int size;

// 集群节点名单(包括 myself 节点),字典的键为节点的名字,字典的值为节点对应的clusterNode结构

@@ -14844,7 +14848,7 @@ CLUSTER MEET

#### 基本操作

-Redis 集群通过分片的方式来保存数据库中的键值对,集群的整个数据库被分为16384 个槽(slot),数据库中的每个键都属于 16384 个槽中的一个,集群中的每个节点可以处理 0 个或最多 16384 个槽(**每个主节点存储的数据并不一样**)

+Redis 集群通过分片的方式来保存数据库中的键值对,集群的整个数据库被分为 16384 个槽(slot),数据库中的每个键都属于 16384 个槽中的一个,集群中的每个节点可以处理 0 个或最多 16384 个槽(**每个主节点存储的数据并不一样**)

* 当数据库中的 16384 个槽都有节点在处理时,集群处于上线状态(ok)

* 如果数据库中有任何一个槽得到处理,那么集群处于下线状态(fail)

@@ -14929,7 +14933,7 @@ typedef struct clusterState {

#### 集群数据

-集群节点保存键值对以及键值对过期时间的方式,与单机 Redis 服务器保存键值对以及键值对过期时间的方式完全相同,但是集群节点只能使用 0 号数据库,单机服务器可以任意使用

+集群节点保存键值对以及键值对过期时间的方式,与单机 Redis 服务器保存键值对以及键值对过期时间的方式完全相同,但是**集群节点只能使用 0 号数据库**,单机服务器可以任意使用

除了将键值对保存在数据库里面之外,节点还会用 clusterState 结构中的 slots_to_keys 跳跃表来**保存槽和键之间的关系**

@@ -15189,7 +15193,7 @@ struct clusterNode {

#### 故障检测

-集群中的每个节点都会定期地向集群中的其他节点发送 PING 消息,来检测对方是否在线,如果接收 PING 的节点没有在规定的时间内返回 PONG 消息,那么发送消息节点就会将接收节点标记为**疑似下线**(probable fail, PFAIL)

+集群中的每个节点都会定期地向集群中的其他节点发送 PING 消息,来检测对方是否在线,如果接收 PING 的节点没有在规定的时间内返回 PONG 消息,那么发送消息节点就会将接收节点标记为**疑似下线**(probable fail)

集群中的节点会互相发送消息,来**交换集群中各个节点的状态信息**,当一个主节点 A 通过消息得知主节点 B 认为主节点 C 进入了疑似下线状态时,主节点 A 会在 clusterState.nodes 字典中找到主节点 C 所对应的节点,并将主节点 B 的下线报告(failure report)添加到 clusterNode.fail_reports 链表里面

@@ -15253,7 +15257,7 @@ struct clusterNodeFailReport {

-选举新主节点的方法和选举领头 Sentinel 的方法非常相似,两者都是基于 Raft 算法的领头选举(eader election)方法实现的

+选举新主节点的方法和选举领头 Sentinel 的方法非常相似,两者都是基于 Raft 算法的领头选举(leader election)方法实现的

@@ -15456,7 +15460,7 @@ typedef struct clusterMsgDataPublish {

### 脑裂问题

-脑裂指在主从集群中,同时有两个相同的主节点能接收写请求,导致客户端不知道应该往哪个主节点写入数据,导致不同客户端往不同的主节点上写入数据

+脑裂指在主从集群中,同时有两个相同的主节点能接收写请求,导致客户端不知道应该往哪个主节点写入数据,最后 不同客户端往不同的主节点上写入数据

* 原主节点并没有真的发生故障,由于某些原因无法处理请求(CPU 利用率很高、自身阻塞),无法按时响应心跳请求,被哨兵/集群主节点错误的判断为下线

* 在被判断下线之后,原主库又重新开始处理请求了,哨兵/集群主节点还没有完成主从切换,客户端仍然可以和原主库通信,客户端发送的写操作就会在原主库上写入数据,造成脑裂问题

@@ -15825,7 +15829,7 @@ OK

Redis 的管道 Pipeline 机制可以一次处理多条指令

* Pipeline 中的多条命令非原子性,因为在向管道内添加命令时,其他客户端的发送的命令仍然在执行

-* 原生批命令(mset 等)是服务端实现,而 pipeline 需要服务端与客户端共同完成

+* 原生批命令(MSET 等)是服务端实现,而 Pipeline 需要服务端与客户端共同完成

使用 Pipeline 封装的命令数量不能太多,数据量过大会增加客户端的等待时间,造成网络阻塞,Jedis 中的 Pipeline 使用方式:

@@ -16135,6 +16139,13 @@ Read-Through Pattern 也存在首次不命中的问题,采用缓存预热解

- 在抢购或秒杀场景下,可能因商品对应库存 Key 的请求量过大,超出 Redis 处理能力造成超卖

- 热 Key 的请求压力数量超出 Redis 的承受能力易造成缓存击穿,即大量请求将被直接指向后端的存储层,导致存储访问量激增甚至宕机,从而影响其他业务

+热 Key 分类两种,治理方式如下:

+

+* 一种是单一数据,比如秒杀场景,假设总量 10000 可以拆为多个 Key 进行访问,每次对请求进行路由到不同的 Key 访问,保证最终一致性,但是会出现访问不同 Key 产生的剩余量是不同的,这时可以通过前端进行 Mock 假数据

+* 一种是多数据集合,比如进行 ID 过滤,这时可以添加本地 LRU 缓存,减少对热 Key 的访问

+

+

+

参考文档:https://help.aliyun.com/document_detail/353223.html

diff --git a/Frame.md b/Frame.md

index 9c7fdaa..f00ae48 100644

--- a/Frame.md

+++ b/Frame.md

@@ -739,9 +739,13 @@ Maven 的插件用来执行生命周期中的相关事件

### 继承

-作用:通过继承可以实现在子工程中沿用父工程中的配置

+Maven 中的继承与 Java 中的继承相似,可以实现在子工程中沿用父工程中的配置

-- Maven 中的继承与 Java 中的继承相似,在子工程中配置继承关系

+dependencyManagement 里只是声明依赖,并不实现引入,所以子工程需要显式声明需要用的依赖

+

+- 如果子工程中未声明依赖,则不会从父项目继承下来

+- 在子工程中声明该依赖项,并且不指定具体版本,才会从父项目中继承该项,version 和 scope 都继承取自父工程 pom 文件

+- 如果子工程中指定了版本号,那么使用子工程中指定的 jar 版本

制作方式:

@@ -3485,7 +3489,7 @@ Kafka 比 RocketMQ 吞吐量高:

Topic 的 partition 数量过多时,Kafka 的性能不如 RocketMQ:

-* 两者都使用文件存储,但是 Kafka 是一个分区一个文件,Topic 过多时分区的总量也会增加,过多的文件导致对消息刷盘时出现文件竞争磁盘,造成性能的下降。一个分区只能被一个消费组中的一个消费线程进行消费,因此可以同时消费的消费端也比较少

+* 两者都使用文件存储,但是 Kafka 是一个分区一个文件,Topic 过多时分区的总量也会增加,过多的文件导致对消息刷盘时出现文件竞争磁盘,造成性能的下降。**一个分区只能被一个消费组中的一个消费线程进行消费**,因此可以同时消费的消费端也比较少

* RocketMQ 所有队列都存储在一个文件中,每个队列存储的消息量也比较小,因此多 Topic 的对 RocketMQ 的性能的影响较小

@@ -4856,7 +4860,7 @@ Consumer 端实现负载均衡的核心类 **RebalanceImpl**

对比下 RebalancePushImpl 和 RebalancePullImpl 两个实现类的 dispatchPullRequest() 方法,RebalancePullImpl 类里面的该方法为空

-消息消费队列在同一消费组不同消费者之间的负载均衡,其核心设计理念是在**一个消息消费队列在同一时间只允许被同一消费组内的一个消费者消费,一个消息消费者能同时消费多个消息队列**

+消息消费队列在**同一消费组不同消费者之间的负载均衡**,其核心设计理念是在**一个消息消费队列在同一时间只允许被同一消费组内的一个消费者消费,一个消息消费者能同时消费多个消息队列**

@@ -10268,13 +10272,14 @@ ConsumeRequest 是 ConsumeMessageOrderlyService 的内部类,是一个 Runnabl

生产流程:

-* 首先获取当前消息主题的发布信息,获取不到去 Namesrv 获取(默认有 TBW102),并将获取的到的路由数据转化为发布数据,**创建 MQ 队列**,客户端实例同样更新订阅数据,创建 MQ 队列,放入负载均衡服务 topicSubscribeInfoTable 中

+* 首先获取当前消息主题的发布信息,获取不到去 Namesrv 获取(默认有 TBW102),并将获取的到的路由数据转化为发布数据,**创建 MQ 队列在多个 Broker 组**(一组代表一主多从的 Broker 架构),客户端实例同样更新订阅数据,创建 MQ 队列,放入负载均衡服务 topicSubscribeInfoTable 中

* 然后从发布数据中选择一个 MQ 队列发送消息

* Broker 端通过 SendMessageProcessor 对发送的消息进行持久化处理,存储到 CommitLog。将重试次数过多的消息加入**死信队列**,将延迟消息的主题和队列修改为调度主题和调度队列 ID

* Broker 启动 ScheduleMessageService 服务会为每个延迟级别创建一个延迟任务,让延迟消息得到有效的处理,将到达交付时间的消息修改为原始主题的原始 ID 存入 CommitLog,消费者就可以进行消费了

消费流程:

+* 消息消费队列 ConsumerQueue 存储消息在 CommitLog 的索引,消费者通过该队列来读取消息实体内容,一个 MQ 就对应一个 CQ

* 首先通过负载均衡服务,将分配到当前消费者实例的 MQ 创建 PullRequest,并放入 PullMessageService 的本地阻塞队列内

* PullMessageService 循环从阻塞队列获取请求对象,发起拉消息请求,并创建 PullCallback 回调对象,将正常拉取的消息**提交到消费任务线程池**,并设置请求的下一次拉取位点,重新放入阻塞队列,形成闭环

* 消费任务服务对消费失败的消息进行回退,通过内部生产者实例发送回退消息,回退失败的消息会再次提交消费任务重新消费

@@ -10771,7 +10776,7 @@ CAP 理论指的是在一个分布式系统中,Consistency(一致性)、Av

CAP 三个基本需求,因为 P 是必须的,因此分布式系统选择就在 CP 或者 AP 中:

* 一致性:指数据在多个副本之间是否能够保持数据一致的特性,当一个系统在数据一致的状态下执行更新操作后,也能保证系统的数据仍然处于一致的状态

-* 可用性:指系统提供的服务必须一直处于可用的状态,对于用户的每一个操作请求总是能够在有限的时间内返回结果

+* 可用性:指系统提供的服务必须一直处于可用的状态,即使集群中一部分节点故障,对于用户的每一个操作请求总是能够在有限的时间内返回结果

* 分区容错性:分布式系统在遇到任何网络分区故障时,仍然能够保证对外提供服务,不会宕机,除非是整个网络环境都发生了故障

diff --git a/Java.md b/Java.md

index ad43393..23a9e8b 100644

--- a/Java.md

+++ b/Java.md

@@ -330,7 +330,7 @@ valueOf() 方法的实现比较简单,就是先判断值是否在缓存池中

- Integer values between -128 and 127

- Character in the range \u0000 to \u007F (0 and 127)

-在 jdk 1.8 所有的数值类缓冲池中,**Integer 的缓存池 IntegerCache 很特殊,这个缓冲池的下界是 -128,上界默认是 127**,但是上界是可调的,在启动 JVM 时通过 `AutoBoxCacheMax=` 来指定这个缓冲池的大小,该选项在 JVM 初始化的时候会设定一个名为 java.lang.IntegerCache.high 系统属性,然后 IntegerCache 初始化的时候就会读取该系统属性来决定上界

+在 jdk 1.8 所有的数值类缓冲池中,**Integer 的缓存池 IntegerCache 很特殊,这个缓冲池的下界是 -128,上界默认是 127**,但是上界是可调的,在启动 JVM 时通过 `AutoBoxCacheMax=` 来指定这个缓冲池的大小,该选项在 JVM 初始化的时候会设定一个名为 java.lang.Integer.IntegerCache 系统属性,然后 IntegerCache 初始化的时候就会读取该系统属性来决定上界

```java

Integer x = 100; // 自动装箱,底层调用 Integer.valueOf(1)

@@ -430,7 +430,7 @@ public static void main(String[] args) {

| 堆内存 | 存储对象或者数组,new 来创建的,都存储在堆内存 |

| 方法栈 | 方法运行时使用的内存,比如 main 方法运行,进入方法栈中执行 |

-**内存分配图**:Java 内存分配

+内存分配图:**Java 数组分配在堆内存**

* 一个数组内存图

@@ -2865,7 +2865,7 @@ public class MyArraysDemo {

1. 导入包:`import java.util.Random`

2. 创建对象:`Random r = new Random()`

3. 随机整数:`int num = r.nextInt(10)`

- * 解释:10 代表的是一个范围,如果括号写 10,产生的随机数就是 0 - 9,括号写 20 的随机数则是 0 - 19

+ * 解释:10 代表的是一个范围,如果括号写 10,产生的随机数就是 0 - 9,括号写 20 的随机数则是 0 - 19

* 获取 0 - 10:`int num = r.nextInt(10 + 1)`

4. 随机小数:`public double nextDouble()` 从范围 `0.0d` 至 `1.0d` (左闭右开),伪随机地生成并返回

@@ -6089,35 +6089,6 @@ public class ExceptionDemo{

5. 算术异常(数学操作异常):ArithmeticException

6. 数字转换异常:NumberFormatException

-```java

-public class ExceptionDemo {

- public static void main(String[] args) {

- System.out.println("程序开始。。。。。。");

- // 1.数组索引越界异常: ArrayIndexOutOfBoundsException。

- int[] arrs = {10 ,20 ,30};

- System.out.println(arrs[3]); //出现了数组索引越界异常。代码在此处直接执行死亡!

-

- // 2.空指针异常 : NullPointerException。

- String name = null ;

- System.out.println(name); // 直接输出没有问题

- System.out.println(name.length());//出现了空指针异常。代码直接执行死亡!

-

- /** 3.类型转换异常:ClassCastException。 */

- Object o = "齐天大圣";

- Integer s = (Integer) o; // 此处出现了类型转换异常。代码在此处直接执行死亡!

-

- /** 5.数学操作异常:ArithmeticException。 */

- int c = 10 / 0 ; // 此处出现了数学操作异常。代码在此处直接执行死亡!

-

- /** 6.数字转换异常: NumberFormatException。 */

- String num = "23aa";

- Integer it = Integer.valueOf(num); //出现了数字转换异常。代码在此处执行死亡!

-

- System.out.println("程序结束。。。。。。");

- }

-}

-```

-

****

@@ -8625,9 +8596,9 @@ public class AnnotationDemo{

}

}

-@Book(value = "《Java基础到精通》", price = 99.5, authors = {"波仔","波妞"})

+@Book(value = "《Java基础到精通》", price = 99.5, authors = {"张三","李四"})

class BookStore{

- @Book(value = "《Mybatis持久层框架》", price = 199.5, authors = {"dlei","播客"})

+ @Book(value = "《Mybatis持久层框架》", price = 199.5, authors = {"王五","小六"})

public void run(){

}

}

@@ -8642,47 +8613,6 @@ class BookStore{

-***

-

-

-

-### 注解模拟

-

-注解模拟写一个 Junit 框架的基本使用

-

-1. 定义一个自定义注解 MyTest,只能注解方法,存活范围一直都在。

-2. 定义若干个方法,只要有 @MyTest 注解的方法就能被触发执行,没有这个注解的方法不能执行!!

-

-```java

-public class TestDemo{

- @MyTest

- public void test01(){System.out.println("===test01===");}

- public void test02(){System.out.println("===test02===");}

- @MyTest

- public void test03(){System.out.println("===test03===");}

- @MyTest

- public void test04(){System.out.println("===test04===");}

-

- public static void main(String[] args) throws Exception {

- TestDemo t = new TestDemo();

- Class c = TestDemo.class;

- Method[] methods = c.getDeclaredMethods();

- for (Method method : methods) {

- if(method.isAnnotationPresent(MyTest.class)){

- method.invoke(t);

- }

- }

- }

-}

-

-@Target(ElementType.METHOD) // 只能注解方法!

-@Retention(RetentionPolicy.RUNTIME) // 一直都活着

-@interface MyTest{

-}

-```

-

-

-

****

@@ -8837,8 +8767,6 @@ XML 文件中常见的组成元素有:文档声明、元素、属性、注释、

#### DTD

-##### DTD 定义

-

DTD 是文档类型定义(Document Type Definition)。DTD 可以定义在 XML 文档中出现的元素、这些元素出现的次序、它们如何相互嵌套以及 XML 文档结构的其它详细信息。

DTD 规则:

@@ -8922,135 +8850,24 @@ DTD 规则:

* 代码

```dtd

-

- id ID #REQUIRED

- 编号 CDATA #IMPLIED

- 出版社 (清华|北大|传智播客) "传智播客"

- type CDATA #FIXED "IT"

+

+ id ID #REQUIRED

+ 编号 CDATA #IMPLIED

+ 出版社 (清华|北大) "清华"

+ type CDATA #FIXED "IT"

>

```

-****

-

-

-

-##### DTD 引入

-

-* 引入本地 dtd

-

- ```dtd

-

- ```

-

-* 在 xml 文件内部引入

-

- ```dtd

-

- ```

-

-* 引入网络 dtd

-

- ```dtd

-

- ```

-

-```dtd

-

-

-

-

-

-```

-

-```xml

-

-

-

-

- 张三

- 23

-

-

-

-```

-

-```xml-dtd

-

-

-

-

-

-

- ]>

-

-

-

- 张三

- 23

-

-

-```

-

-```dtd

-

-

-

-

-

- 张三

- 23

-

-

-```

-

-

-

-***

-

-

-

-##### DTD 实现

-

-persondtd.dtd 文件

-

-```dtd

-

-

-

-

-

-```

-

-```xml-dtd

-

-

-

-

-

- 张三

- 23

-

-

-

- 张三

- 23

-

-

-```

-

-

-

***

#### Schema

-##### XSD 定义

+XSD 定义:

1. Schema 语言也可作为 XSD(XML Schema Definition)

2. Schema 约束文件本身也是一个 XML 文件,符合 XML 的语法,这个文件的后缀名 .xsd

@@ -9058,13 +8875,7 @@ persondtd.dtd 文件

4. dtd 里面元素类型的取值比较单一常见的是 PCDATA 类型,但是在 Schema 里面可以支持很多个数据类型

5. **Schema 文件约束 XML 文件的同时也被别的文件约束着**

-

-

-***

-

-

-

-##### XSD 规则

+XSD 规则:

1. 创建一个文件,这个文件的后缀名为 .xsd

2. 定义文档声明

@@ -9111,88 +8922,6 @@ person.xsd

-****

-

-

-

-##### XSD 引入

-

-1. 在根标签上定义属性 xmlns="http://www.w3.org/2001/XMLSchema-instance"

-2. **通过 xmlns 引入约束文件的名称空间**

-3. 给某一个 xmlns 属性添加一个标识,用于区分不同的名称空间,格式为 `xmlns:标识="名称空间url"` ,标识可以是任意的,但是一般取值都是 xsi

-4. 通过 xsi:schemaLocation 指定名称空间所对应的约束文件路径,格式为 `xsi:schemaLocation = "名称空间url 文件路径`

-

-```scheme

-

-

- xmlns="http://www.seazean.cn/javase"

- xsi:schemaLocation="http://www.seazean.cn/javase person.xsd"

->

-

-

- 张三

- 23

-

-

-

-```

-

-

-

-****

-

-

-

-##### XSD 属性

-

-```scheme

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

- 张三

- 23

-

-

-

-```

-

***

@@ -9256,7 +8985,7 @@ public class Dom4JDemo {

JavaWeb开发教程

- 张孝祥

+ 张三

100.00元

@@ -9390,8 +9119,6 @@ public class Dom4JDemo {

System.out.println(bookEle.elementTextTrim("name")); // 去前后空格

System.out.println(bookEle.elementText("author"));

System.out.println(bookEle.elementTextTrim("author")); // 去前后空格

- System.out.println(bookEle.elementText("sale"));

- System.out.println(bookEle.elementTextTrim("sale")); // 去前后空格

// 6.先获取到子元素对象,再获取该文本值

Element bookNameEle = bookEle.element("name");

@@ -10596,23 +10323,26 @@ Return Address:存放调用该方法的 PC 寄存器的值

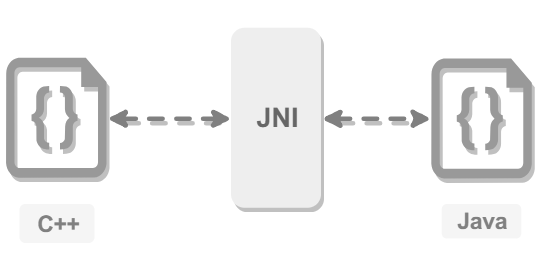

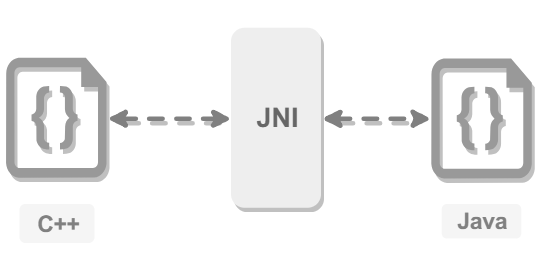

本地方法栈是为虚拟机执行本地方法时提供服务的

-JNI:Java Native Interface,通过使用 Java 本地接口书写程序,可以确保代码在不同的平台上方便移植

+JNI:Java Native Interface,通过使用 Java 本地接口程序,可以确保代码在不同的平台上方便移植

* 不需要进行 GC,与虚拟机栈类似,也是线程私有的,有 StackOverFlowError 和 OutOfMemoryError 异常

-

* 虚拟机栈执行的是 Java 方法,在 HotSpot JVM 中,直接将本地方法栈和虚拟机栈合二为一

-

* 本地方法一般是由其他语言编写,并且被编译为基于本机硬件和操作系统的程序

-

* 当某个线程调用一个本地方法时,就进入了不再受虚拟机限制的世界,和虚拟机拥有同样的权限

* 本地方法可以通过本地方法接口来**访问虚拟机内部的运行时数据区**

* 直接从本地内存的堆中分配任意数量的内存

* 可以直接使用本地处理器中的寄存器

-

@@ -10799,7 +10794,7 @@ SDS 通过未使用空间解除了字符串长度和底层数组长度之间的

内存重分配涉及复杂的算法,需要执行**系统调用**,是一个比较耗时的操作,SDS 的两种优化策略:

-* 空间预分配:当 SDS需要进行空间扩展时,程序不仅会为 SDS 分配修改所必需的空间, 还会为 SDS 分配额外的未使用空间

+* 空间预分配:当 SDS 需要进行空间扩展时,程序不仅会为 SDS 分配修改所必需的空间, 还会为 SDS 分配额外的未使用空间

* 对 SDS 修改之后,SDS 的长度(len 属性)小于 1MB,程序分配和 len 属性同样大小的未使用空间,此时 len 和 free 相等

@@ -11010,7 +11005,7 @@ load_factor = ht[0].used / ht[0].size

原因:执行该命令的过程中,Redis 需要创建当前服务器进程的子进程,而大多数操作系统都采用写时复制(copy-on-write)技术来优化子进程的使用效率,通过提高执行扩展操作的负载因子,尽可能地避免在子进程存在期间进行哈希表扩展操作,可以避免不必要的内存写入操作,最大限度地节约内存

-哈希表执行收缩的条件:负载因子小于 0.1(自动执行,servreCron 中检测),缩小为字典中数据个数的 50% 左右

+哈希表执行收缩的条件:负载因子小于 0.1(自动执行,servreCron 中检测)

@@ -11553,7 +11548,7 @@ Redis 所有操作都是**原子性**的,采用**单线程**机制,命令是

-#### 对象

+#### 实现

字符串对象的编码可以是 int、raw、embstr 三种

@@ -12100,6 +12095,11 @@ set 类型:与 hash 存储结构哈希表完全相同,只是仅存储键不

当元素比较多时,此时 ziplist 的读写效率会下降,时间复杂度是 O(n),跳表的时间复杂度是 O(logn)

+为什么用跳表而不用平衡树?

+

+* 在做范围查找的时候,跳表操作简单(前进指针或后退指针),平衡树需要回旋查找

+* 跳表比平衡树实现简单,平衡树的插入和删除操作可能引发子树的旋转调整,而跳表的插入和删除只需要修改相邻节点的指针

+

***

@@ -12354,7 +12354,7 @@ AOF:将数据的操作过程进行保存,日志形式,存储操作过程

#### 文件创建

-RDB 持久化功能所生成的 RDB 文件 是一个经过压缩的紧凑二进制文件,通过该文件可以还原生成 RDB 文件时的数据库状态,有两个 Redis 命令可以生成 RDB 文件,一个是 SAVE,另一个是 BGSAVE

+RDB 持久化功能所生成的 RDB 文件是一个经过压缩的紧凑二进制文件,通过该文件可以还原生成 RDB 文件时的数据库状态,有两个 Redis 命令可以生成 RDB 文件,一个是 SAVE,另一个是 BGSAVE

@@ -12655,12 +12655,12 @@ appendfsync always|everysec|no #AOF写数据策略:默认为everysec

特点:安全性最高,数据零误差,但是性能较低,不建议使用

-- everysec:先将 aof_buf 缓冲区中的内容写入到 AOF 文件,判断上次同步 AOF 文件的时间距离现在超过一秒钟,再次对 AOF 文件进行同步 fsync,这个同步操作是由一个(子)线程专门负责执行的

+- everysec:先将 aof_buf 缓冲区中的内容写入到操作系统缓存,判断上次同步 AOF 文件的时间距离现在超过一秒钟,再次进行同步 fsync,这个同步操作是由一个(子)线程专门负责执行的

特点:在系统突然宕机的情况下丢失 1 秒内的数据,准确性较高,性能较高,建议使用,也是默认配置

-- no:将 aof_buf 缓冲区中的内容写入到 AOF 文件,但并不对 AOF 文件进行同步,何时同步由操作系统来决定

+- no:将 aof_buf 缓冲区中的内容写入到操作系统缓存,但并不进行同步,何时同步由操作系统来决定

特点:**整体不可控**,服务器宕机会丢失上次同步 AOF 后的所有写指令

@@ -12758,7 +12758,7 @@ bgrewriteaof

* 子进程进行 AOF 重写期间,服务器进程(父进程)可以继续处理命令请求

-* 子进程带有服务器进程的数据副本,使用子进程而不是线程,可以在避免使用锁的情况下, 保证数据的安全性

+* 子进程带有服务器进程的数据副本,使用子进程而不是线程,可以在避免使用锁的情况下, 保证数据安全性

@@ -13495,7 +13495,7 @@ Redis 分布式锁的基本使用,悲观锁

`NX`:只在键不存在时,才对键进行设置操作,`SET key value NX` 效果等同于 `SETNX key value`

- `XX` :只在键已经存在时,才对键进行设置操作

+ `XX`:只在键已经存在时,才对键进行设置操作

`EX`:设置键 key 的过期时间,单位时秒

@@ -13633,7 +13633,7 @@ end

主从一致性:集群模式下,主从同步存在延迟,当加锁后主服务器宕机时,从服务器还没同步主服务器中的锁数据,此时从服务器升级为主服务器,其他线程又可以获取到锁

-将服务器升级为多主多从,:

+将服务器升级为多主多从:

* 获取锁需要从所有主服务器 SET 成功才算获取成功

* 某个 master 宕机,slave 还没有同步锁数据就升级为 master,其他线程尝试加锁会加锁失败,因为其他 master 上已经存在该锁

@@ -14007,7 +14007,7 @@ PSYNC 命令的调用方法有两种

#### 心跳机制

-心跳机制:进入命令传播阶段,从服务器默认会以每秒一次的频率,向主服务器发送命令:`REPLCONF ACK `,re_offset 是从服务器当前的复制偏移量

+心跳机制:进入命令传播阶段,**从服务器**默认会以每秒一次的频率,**向主服务器发送命令**:`REPLCONF ACK `,replication_offset 是从服务器当前的复制偏移量

心跳的作用:

@@ -14046,7 +14046,7 @@ slavel: ip=127.0.0.1,port=22222,state=online,offset=456,lag=3 # 3秒之前发送

#### 配置选项

-Redis 的 min-slaves-to-write 和 min-slaves-max-lag 两个选项可以防止主服务器在**不安全的情况下**执行写命令

+Redis 的 min-slaves-to-write 和 min-slaves-max-lag 两个选项可以防止主服务器在**不安全的情况下**拒绝执行写命令

比如向主服务器设置:

@@ -14113,7 +14113,7 @@ master 的 CPU 占用过高或 slave 频繁断开连接

* 出现的原因:

* slave 每 1 秒发送 REPLCONF ACK 命令到 master

- * 当 slave 接到了慢查询时(keys * ,hgetall等),会大量占用 CPU 性能

+ * 当 slave 接到了慢查询时(keys * ,hgetall 等),会大量占用 CPU 性能

* master 每 1 秒调用复制定时函数 replicationCron(),比对 slave 发现长时间没有进行响应

最终导致 master 各种资源(输出缓冲区、带宽、连接等)被严重占用

@@ -14277,7 +14277,7 @@ Sentinel 本质上只是一个运行在特殊模式下的 Redis 服务器,当

#### 代码替换

-将一部分普通 Redis服务器使用的代码替换成 Sentinel 专用代码

+将一部分普通 Redis 服务器使用的代码替换成 Sentinel 专用代码

Redis 服务器端口:

@@ -14321,7 +14321,7 @@ struct sentinelState {

// 当前纪元,用于实现故障转移

uint64_t current_epoch;

- // 保存了所有被这个sentinel监视的主服务器

+ // 【保存了所有被这个sentinel监视的主服务器】

dict *masters;

// 是否进入了 TILT 模式

@@ -14438,10 +14438,10 @@ typedef struct sentinelAddr {

##### 主服务器

-Sentinel 默认会以每十秒一次的频率,通过命令连接向被监视的主服务器发送 INFO 命令,来获取主服务器的当前信息

+Sentinel 默认会以每十秒一次的频率,通过命令连接向被监视的主服务器发送 INFO 命令,来获取主服务器的信息

* 一部分是主服务器本身的信息,包括 runid 域记录的服务器运行 ID,以及 role 域记录的服务器角色

-* 另一部分是服务器属下所有从服务器的信息,每个从服务器都由一个 slave 字符串开头的行记录,根据这些 IP 地址和端口号,Sentinel 无须用户提供从服务器的地址信息,就可以自动发现从服务器

+* 另一部分是服务器属下所有从服务器的信息,每个从服务器都由一个 slave 字符串开头的行记录,根据这些 IP 地址和端口号,Sentinel 无须用户提供从服务器的地址信息,就可以**自动发现从服务器**

```sh

# Server

@@ -14470,7 +14470,7 @@ slave1: ip=l27.0.0.1, port=22222, state=online, offset=22, lag=0

##### 从服务器

-当 Sentinel 发现主服务器有新的从服务器出现时,会为这个新的从服务器创建相应的实例结构,还会创建到从服务器的命令连接和订阅连接,所以 Sentinel 对所有的从服务器之间都可以进行命令操作

+当 Sentinel 发现主服务器有新的从服务器出现时,会为这个新的从服务器创建相应的实例结构,还会**创建到从服务器的命令连接和订阅连接**,所以 Sentinel 对所有的从服务器之间都可以进行命令操作

Sentinel 默认会以每十秒一次的频率,向从服务器发送 INFO 命令:

@@ -14614,7 +14614,7 @@ SENTINEL is-master-down-by-addr

源 Sentinel 将统计其他 Sentinel 同意主服务器已下线的数量,当这一数量达到配置指定的判断客观下线所需的数量(quorum)时,Sentinel 会将主服务器对应实例结构 flags 属性的 SRI_O_DOWN 标识打开,代表客观下线,并对主服务器执行故障转移操作

-注意:**不同 Sentinel 判断客观下线的条件可能不同**,因为载入的配置文件中的属性(quorum)可能不同

+注意:**不同 Sentinel 判断客观下线的条件可能不同**,因为载入的配置文件中的属性 quorum 可能不同

@@ -14624,7 +14624,7 @@ SENTINEL is-master-down-by-addr

### 领头选举

-主服务器被判断为客观下线时,监视这个主服务器的各个 Sentinel 会进行协商,选举出一个领头 Sentinel 对下线服务器执行故障转移

+主服务器被判断为客观下线时,**监视该主服务器的各个 Sentinel 会进行协商**,选举出一个领头 Sentinel 对下线服务器执行故障转移

Redis 选举领头 Sentinel 的规则:

@@ -14633,7 +14633,7 @@ Redis 选举领头 Sentinel 的规则:

* 在一个配置纪元里,所有 Sentinel 都只有一次将某个 Sentinel 设置为局部领头 Sentinel 的机会,并且局部领头一旦设置,在这个配置纪元里就不能再更改

* Sentinel 设置局部领头 Sentinel 的规则是先到先得,最先向目标 Sentinel 发送设置要求的源 Sentinel 将成为目标 Sentinel 的局部领头 Sentinel,之后接收到的所有设置要求都会被目标 Sentinel 拒绝

-* 领头 Sentinel 的产生需要半数以上 Sentinel 的支持,并且每个 Sentinel 只有一票,所以一个配置纪元只会出现一个领头 Sentinel,比如 10 个 Sentinel 的系统中,至少需要 `10/2 + 1 = 6` 票

+* 领头 Sentinel 的产生**需要半数以上 Sentinel 的支持**,并且每个 Sentinel 只有一票,所以一个配置纪元只会出现一个领头 Sentinel,比如 10 个 Sentinel 的系统中,至少需要 `10/2 + 1 = 6` 票

选举过程:

@@ -14641,7 +14641,7 @@ Redis 选举领头 Sentinel 的规则:

* 目标 Sentinel 接受命令处理完成后,将返回一条命令回复,回复中的 leader_runid 和 leader_epoch 参数分别记录了目标 Sentinel 的局部领头 Sentinel 的运行 ID 和配置纪元

* 源 Sentinel 接收目标 Sentinel 命令回复之后,会判断 leader_epoch 是否和自己的相同,相同就继续判断 leader_runid 是否和自己的运行 ID 一致,成立表示目标 Sentinel 将源 Sentinel 设置成了局部领头 Sentinel,即获得一票

* 如果某个 Sentinel 被半数以上的 Sentinel 设置成了局部领头 Sentinel,那么这个 Sentinel 成为领头 Sentinel

-* 如果在给定时限内,没有一个 Sentinel 被选举为领头 Sentinel,那么各个 Sentinel 将在一段时间后再次选举,直到选出领头

+* 如果在给定时限内,没有一个 Sentinel 被选举为领头 Sentinel,那么各个 Sentinel 将在一段时间后**再次选举**,直到选出领头

* 每次进行领头 Sentinel 选举之后,不论选举是否成功,所有 Sentinel 的配置纪元(configuration epoch)都要自增一次

Sentinel 集群至少 3 个节点的原因:

@@ -14649,7 +14649,10 @@ Sentinel 集群至少 3 个节点的原因:

* 如果 Sentinel 集群只有 2 个 Sentinel 节点,则领头选举需要 `2/2 + 1 = 2` 票,如果一个节点挂了,那就永远选不出领头

* Sentinel 集群允许 1 个 Sentinel 节点故障则需要 3 个节点的集群,允许 2 个节点故障则需要 5 个节点集群

+**如何获取哨兵节点的半数数量**?

+* 客观下线是通过配置文件获取的数量,达到 quorum 就客观下线

+* 哨兵数量是通过主节点是实例结构中,保存着监视该主节点的所有哨兵信息,从而获取得到

@@ -14748,7 +14751,8 @@ typedef struct clusterState {

// 集群当前的状态,是在线还是下线

int state;

- // 集群中至少处理着一个槽的节点的数量,为0表示集群目前没有任何节点在处理槽

+ // 集群中至少处理着一个槽的(主)节点的数量,为0表示集群目前没有任何节点在处理槽

+ // 【选举时投票数量超过半数,从这里获取的】

int size;

// 集群节点名单(包括 myself 节点),字典的键为节点的名字,字典的值为节点对应的clusterNode结构

@@ -14844,7 +14848,7 @@ CLUSTER MEET

#### 基本操作

-Redis 集群通过分片的方式来保存数据库中的键值对,集群的整个数据库被分为16384 个槽(slot),数据库中的每个键都属于 16384 个槽中的一个,集群中的每个节点可以处理 0 个或最多 16384 个槽(**每个主节点存储的数据并不一样**)

+Redis 集群通过分片的方式来保存数据库中的键值对,集群的整个数据库被分为 16384 个槽(slot),数据库中的每个键都属于 16384 个槽中的一个,集群中的每个节点可以处理 0 个或最多 16384 个槽(**每个主节点存储的数据并不一样**)

* 当数据库中的 16384 个槽都有节点在处理时,集群处于上线状态(ok)

* 如果数据库中有任何一个槽得到处理,那么集群处于下线状态(fail)

@@ -14929,7 +14933,7 @@ typedef struct clusterState {

#### 集群数据

-集群节点保存键值对以及键值对过期时间的方式,与单机 Redis 服务器保存键值对以及键值对过期时间的方式完全相同,但是集群节点只能使用 0 号数据库,单机服务器可以任意使用

+集群节点保存键值对以及键值对过期时间的方式,与单机 Redis 服务器保存键值对以及键值对过期时间的方式完全相同,但是**集群节点只能使用 0 号数据库**,单机服务器可以任意使用

除了将键值对保存在数据库里面之外,节点还会用 clusterState 结构中的 slots_to_keys 跳跃表来**保存槽和键之间的关系**

@@ -15189,7 +15193,7 @@ struct clusterNode {

#### 故障检测

-集群中的每个节点都会定期地向集群中的其他节点发送 PING 消息,来检测对方是否在线,如果接收 PING 的节点没有在规定的时间内返回 PONG 消息,那么发送消息节点就会将接收节点标记为**疑似下线**(probable fail, PFAIL)

+集群中的每个节点都会定期地向集群中的其他节点发送 PING 消息,来检测对方是否在线,如果接收 PING 的节点没有在规定的时间内返回 PONG 消息,那么发送消息节点就会将接收节点标记为**疑似下线**(probable fail)

集群中的节点会互相发送消息,来**交换集群中各个节点的状态信息**,当一个主节点 A 通过消息得知主节点 B 认为主节点 C 进入了疑似下线状态时,主节点 A 会在 clusterState.nodes 字典中找到主节点 C 所对应的节点,并将主节点 B 的下线报告(failure report)添加到 clusterNode.fail_reports 链表里面

@@ -15253,7 +15257,7 @@ struct clusterNodeFailReport {

-选举新主节点的方法和选举领头 Sentinel 的方法非常相似,两者都是基于 Raft 算法的领头选举(eader election)方法实现的

+选举新主节点的方法和选举领头 Sentinel 的方法非常相似,两者都是基于 Raft 算法的领头选举(leader election)方法实现的

@@ -15456,7 +15460,7 @@ typedef struct clusterMsgDataPublish {

### 脑裂问题

-脑裂指在主从集群中,同时有两个相同的主节点能接收写请求,导致客户端不知道应该往哪个主节点写入数据,导致不同客户端往不同的主节点上写入数据

+脑裂指在主从集群中,同时有两个相同的主节点能接收写请求,导致客户端不知道应该往哪个主节点写入数据,最后 不同客户端往不同的主节点上写入数据

* 原主节点并没有真的发生故障,由于某些原因无法处理请求(CPU 利用率很高、自身阻塞),无法按时响应心跳请求,被哨兵/集群主节点错误的判断为下线

* 在被判断下线之后,原主库又重新开始处理请求了,哨兵/集群主节点还没有完成主从切换,客户端仍然可以和原主库通信,客户端发送的写操作就会在原主库上写入数据,造成脑裂问题

@@ -15825,7 +15829,7 @@ OK

Redis 的管道 Pipeline 机制可以一次处理多条指令

* Pipeline 中的多条命令非原子性,因为在向管道内添加命令时,其他客户端的发送的命令仍然在执行

-* 原生批命令(mset 等)是服务端实现,而 pipeline 需要服务端与客户端共同完成

+* 原生批命令(MSET 等)是服务端实现,而 Pipeline 需要服务端与客户端共同完成

使用 Pipeline 封装的命令数量不能太多,数据量过大会增加客户端的等待时间,造成网络阻塞,Jedis 中的 Pipeline 使用方式:

@@ -16135,6 +16139,13 @@ Read-Through Pattern 也存在首次不命中的问题,采用缓存预热解

- 在抢购或秒杀场景下,可能因商品对应库存 Key 的请求量过大,超出 Redis 处理能力造成超卖

- 热 Key 的请求压力数量超出 Redis 的承受能力易造成缓存击穿,即大量请求将被直接指向后端的存储层,导致存储访问量激增甚至宕机,从而影响其他业务

+热 Key 分类两种,治理方式如下:

+

+* 一种是单一数据,比如秒杀场景,假设总量 10000 可以拆为多个 Key 进行访问,每次对请求进行路由到不同的 Key 访问,保证最终一致性,但是会出现访问不同 Key 产生的剩余量是不同的,这时可以通过前端进行 Mock 假数据

+* 一种是多数据集合,比如进行 ID 过滤,这时可以添加本地 LRU 缓存,减少对热 Key 的访问

+

+

+

参考文档:https://help.aliyun.com/document_detail/353223.html

diff --git a/Frame.md b/Frame.md

index 9c7fdaa..f00ae48 100644

--- a/Frame.md

+++ b/Frame.md

@@ -739,9 +739,13 @@ Maven 的插件用来执行生命周期中的相关事件

### 继承

-作用:通过继承可以实现在子工程中沿用父工程中的配置

+Maven 中的继承与 Java 中的继承相似,可以实现在子工程中沿用父工程中的配置

-- Maven 中的继承与 Java 中的继承相似,在子工程中配置继承关系

+dependencyManagement 里只是声明依赖,并不实现引入,所以子工程需要显式声明需要用的依赖

+

+- 如果子工程中未声明依赖,则不会从父项目继承下来

+- 在子工程中声明该依赖项,并且不指定具体版本,才会从父项目中继承该项,version 和 scope 都继承取自父工程 pom 文件

+- 如果子工程中指定了版本号,那么使用子工程中指定的 jar 版本

制作方式:

@@ -3485,7 +3489,7 @@ Kafka 比 RocketMQ 吞吐量高:

Topic 的 partition 数量过多时,Kafka 的性能不如 RocketMQ:

-* 两者都使用文件存储,但是 Kafka 是一个分区一个文件,Topic 过多时分区的总量也会增加,过多的文件导致对消息刷盘时出现文件竞争磁盘,造成性能的下降。一个分区只能被一个消费组中的一个消费线程进行消费,因此可以同时消费的消费端也比较少

+* 两者都使用文件存储,但是 Kafka 是一个分区一个文件,Topic 过多时分区的总量也会增加,过多的文件导致对消息刷盘时出现文件竞争磁盘,造成性能的下降。**一个分区只能被一个消费组中的一个消费线程进行消费**,因此可以同时消费的消费端也比较少

* RocketMQ 所有队列都存储在一个文件中,每个队列存储的消息量也比较小,因此多 Topic 的对 RocketMQ 的性能的影响较小

@@ -4856,7 +4860,7 @@ Consumer 端实现负载均衡的核心类 **RebalanceImpl**

对比下 RebalancePushImpl 和 RebalancePullImpl 两个实现类的 dispatchPullRequest() 方法,RebalancePullImpl 类里面的该方法为空

-消息消费队列在同一消费组不同消费者之间的负载均衡,其核心设计理念是在**一个消息消费队列在同一时间只允许被同一消费组内的一个消费者消费,一个消息消费者能同时消费多个消息队列**

+消息消费队列在**同一消费组不同消费者之间的负载均衡**,其核心设计理念是在**一个消息消费队列在同一时间只允许被同一消费组内的一个消费者消费,一个消息消费者能同时消费多个消息队列**

@@ -10268,13 +10272,14 @@ ConsumeRequest 是 ConsumeMessageOrderlyService 的内部类,是一个 Runnabl

生产流程:

-* 首先获取当前消息主题的发布信息,获取不到去 Namesrv 获取(默认有 TBW102),并将获取的到的路由数据转化为发布数据,**创建 MQ 队列**,客户端实例同样更新订阅数据,创建 MQ 队列,放入负载均衡服务 topicSubscribeInfoTable 中

+* 首先获取当前消息主题的发布信息,获取不到去 Namesrv 获取(默认有 TBW102),并将获取的到的路由数据转化为发布数据,**创建 MQ 队列在多个 Broker 组**(一组代表一主多从的 Broker 架构),客户端实例同样更新订阅数据,创建 MQ 队列,放入负载均衡服务 topicSubscribeInfoTable 中

* 然后从发布数据中选择一个 MQ 队列发送消息

* Broker 端通过 SendMessageProcessor 对发送的消息进行持久化处理,存储到 CommitLog。将重试次数过多的消息加入**死信队列**,将延迟消息的主题和队列修改为调度主题和调度队列 ID

* Broker 启动 ScheduleMessageService 服务会为每个延迟级别创建一个延迟任务,让延迟消息得到有效的处理,将到达交付时间的消息修改为原始主题的原始 ID 存入 CommitLog,消费者就可以进行消费了

消费流程:

+* 消息消费队列 ConsumerQueue 存储消息在 CommitLog 的索引,消费者通过该队列来读取消息实体内容,一个 MQ 就对应一个 CQ

* 首先通过负载均衡服务,将分配到当前消费者实例的 MQ 创建 PullRequest,并放入 PullMessageService 的本地阻塞队列内

* PullMessageService 循环从阻塞队列获取请求对象,发起拉消息请求,并创建 PullCallback 回调对象,将正常拉取的消息**提交到消费任务线程池**,并设置请求的下一次拉取位点,重新放入阻塞队列,形成闭环

* 消费任务服务对消费失败的消息进行回退,通过内部生产者实例发送回退消息,回退失败的消息会再次提交消费任务重新消费

@@ -10771,7 +10776,7 @@ CAP 理论指的是在一个分布式系统中,Consistency(一致性)、Av

CAP 三个基本需求,因为 P 是必须的,因此分布式系统选择就在 CP 或者 AP 中:

* 一致性:指数据在多个副本之间是否能够保持数据一致的特性,当一个系统在数据一致的状态下执行更新操作后,也能保证系统的数据仍然处于一致的状态

-* 可用性:指系统提供的服务必须一直处于可用的状态,对于用户的每一个操作请求总是能够在有限的时间内返回结果

+* 可用性:指系统提供的服务必须一直处于可用的状态,即使集群中一部分节点故障,对于用户的每一个操作请求总是能够在有限的时间内返回结果

* 分区容错性:分布式系统在遇到任何网络分区故障时,仍然能够保证对外提供服务,不会宕机,除非是整个网络环境都发生了故障

diff --git a/Java.md b/Java.md

index ad43393..23a9e8b 100644

--- a/Java.md

+++ b/Java.md

@@ -330,7 +330,7 @@ valueOf() 方法的实现比较简单,就是先判断值是否在缓存池中

- Integer values between -128 and 127

- Character in the range \u0000 to \u007F (0 and 127)

-在 jdk 1.8 所有的数值类缓冲池中,**Integer 的缓存池 IntegerCache 很特殊,这个缓冲池的下界是 -128,上界默认是 127**,但是上界是可调的,在启动 JVM 时通过 `AutoBoxCacheMax=` 来指定这个缓冲池的大小,该选项在 JVM 初始化的时候会设定一个名为 java.lang.IntegerCache.high 系统属性,然后 IntegerCache 初始化的时候就会读取该系统属性来决定上界

+在 jdk 1.8 所有的数值类缓冲池中,**Integer 的缓存池 IntegerCache 很特殊,这个缓冲池的下界是 -128,上界默认是 127**,但是上界是可调的,在启动 JVM 时通过 `AutoBoxCacheMax=` 来指定这个缓冲池的大小,该选项在 JVM 初始化的时候会设定一个名为 java.lang.Integer.IntegerCache 系统属性,然后 IntegerCache 初始化的时候就会读取该系统属性来决定上界

```java

Integer x = 100; // 自动装箱,底层调用 Integer.valueOf(1)

@@ -430,7 +430,7 @@ public static void main(String[] args) {

| 堆内存 | 存储对象或者数组,new 来创建的,都存储在堆内存 |

| 方法栈 | 方法运行时使用的内存,比如 main 方法运行,进入方法栈中执行 |

-**内存分配图**:Java 内存分配

+内存分配图:**Java 数组分配在堆内存**

* 一个数组内存图

@@ -2865,7 +2865,7 @@ public class MyArraysDemo {

1. 导入包:`import java.util.Random`

2. 创建对象:`Random r = new Random()`

3. 随机整数:`int num = r.nextInt(10)`

- * 解释:10 代表的是一个范围,如果括号写 10,产生的随机数就是 0 - 9,括号写 20 的随机数则是 0 - 19

+ * 解释:10 代表的是一个范围,如果括号写 10,产生的随机数就是 0 - 9,括号写 20 的随机数则是 0 - 19

* 获取 0 - 10:`int num = r.nextInt(10 + 1)`

4. 随机小数:`public double nextDouble()` 从范围 `0.0d` 至 `1.0d` (左闭右开),伪随机地生成并返回

@@ -6089,35 +6089,6 @@ public class ExceptionDemo{

5. 算术异常(数学操作异常):ArithmeticException

6. 数字转换异常:NumberFormatException

-```java

-public class ExceptionDemo {

- public static void main(String[] args) {

- System.out.println("程序开始。。。。。。");

- // 1.数组索引越界异常: ArrayIndexOutOfBoundsException。

- int[] arrs = {10 ,20 ,30};

- System.out.println(arrs[3]); //出现了数组索引越界异常。代码在此处直接执行死亡!

-

- // 2.空指针异常 : NullPointerException。

- String name = null ;

- System.out.println(name); // 直接输出没有问题

- System.out.println(name.length());//出现了空指针异常。代码直接执行死亡!

-

- /** 3.类型转换异常:ClassCastException。 */

- Object o = "齐天大圣";

- Integer s = (Integer) o; // 此处出现了类型转换异常。代码在此处直接执行死亡!

-

- /** 5.数学操作异常:ArithmeticException。 */

- int c = 10 / 0 ; // 此处出现了数学操作异常。代码在此处直接执行死亡!

-

- /** 6.数字转换异常: NumberFormatException。 */

- String num = "23aa";

- Integer it = Integer.valueOf(num); //出现了数字转换异常。代码在此处执行死亡!

-

- System.out.println("程序结束。。。。。。");

- }

-}

-```

-

****

@@ -8625,9 +8596,9 @@ public class AnnotationDemo{

}

}

-@Book(value = "《Java基础到精通》", price = 99.5, authors = {"波仔","波妞"})

+@Book(value = "《Java基础到精通》", price = 99.5, authors = {"张三","李四"})

class BookStore{

- @Book(value = "《Mybatis持久层框架》", price = 199.5, authors = {"dlei","播客"})

+ @Book(value = "《Mybatis持久层框架》", price = 199.5, authors = {"王五","小六"})

public void run(){

}

}

@@ -8642,47 +8613,6 @@ class BookStore{

-***

-

-

-

-### 注解模拟

-

-注解模拟写一个 Junit 框架的基本使用

-

-1. 定义一个自定义注解 MyTest,只能注解方法,存活范围一直都在。

-2. 定义若干个方法,只要有 @MyTest 注解的方法就能被触发执行,没有这个注解的方法不能执行!!

-

-```java

-public class TestDemo{

- @MyTest

- public void test01(){System.out.println("===test01===");}

- public void test02(){System.out.println("===test02===");}

- @MyTest

- public void test03(){System.out.println("===test03===");}

- @MyTest

- public void test04(){System.out.println("===test04===");}

-

- public static void main(String[] args) throws Exception {

- TestDemo t = new TestDemo();

- Class c = TestDemo.class;

- Method[] methods = c.getDeclaredMethods();

- for (Method method : methods) {

- if(method.isAnnotationPresent(MyTest.class)){

- method.invoke(t);

- }

- }

- }

-}

-

-@Target(ElementType.METHOD) // 只能注解方法!

-@Retention(RetentionPolicy.RUNTIME) // 一直都活着

-@interface MyTest{

-}

-```

-

-

-

****

@@ -8837,8 +8767,6 @@ XML 文件中常见的组成元素有:文档声明、元素、属性、注释、

#### DTD

-##### DTD 定义

-

DTD 是文档类型定义(Document Type Definition)。DTD 可以定义在 XML 文档中出现的元素、这些元素出现的次序、它们如何相互嵌套以及 XML 文档结构的其它详细信息。

DTD 规则:

@@ -8922,135 +8850,24 @@ DTD 规则:

* 代码

```dtd

-

- id ID #REQUIRED

- 编号 CDATA #IMPLIED

- 出版社 (清华|北大|传智播客) "传智播客"

- type CDATA #FIXED "IT"

+

+ id ID #REQUIRED

+ 编号 CDATA #IMPLIED

+ 出版社 (清华|北大) "清华"

+ type CDATA #FIXED "IT"

>

```

-****

-

-

-

-##### DTD 引入

-

-* 引入本地 dtd

-

- ```dtd

-

- ```

-

-* 在 xml 文件内部引入

-

- ```dtd

-

- ```

-

-* 引入网络 dtd

-

- ```dtd

-

- ```

-

-```dtd

-

-

-

-

-

-```

-

-```xml

-

-

-

-

- 张三

- 23

-

-

-

-```

-

-```xml-dtd

-

-

-

-

-

-

- ]>

-

-

-

- 张三

- 23

-

-

-```

-

-```dtd

-

-

-

-

-

- 张三

- 23

-

-

-```

-

-

-

-***

-

-

-

-##### DTD 实现

-

-persondtd.dtd 文件

-

-```dtd

-

-

-

-

-

-```

-

-```xml-dtd

-

-

-

-

-

- 张三

- 23

-

-

-

- 张三

- 23

-

-

-```

-

-

-

***

#### Schema

-##### XSD 定义

+XSD 定义:

1. Schema 语言也可作为 XSD(XML Schema Definition)

2. Schema 约束文件本身也是一个 XML 文件,符合 XML 的语法,这个文件的后缀名 .xsd

@@ -9058,13 +8875,7 @@ persondtd.dtd 文件

4. dtd 里面元素类型的取值比较单一常见的是 PCDATA 类型,但是在 Schema 里面可以支持很多个数据类型

5. **Schema 文件约束 XML 文件的同时也被别的文件约束着**

-

-

-***

-

-

-

-##### XSD 规则

+XSD 规则:

1. 创建一个文件,这个文件的后缀名为 .xsd

2. 定义文档声明

@@ -9111,88 +8922,6 @@ person.xsd

-****

-

-

-

-##### XSD 引入

-

-1. 在根标签上定义属性 xmlns="http://www.w3.org/2001/XMLSchema-instance"

-2. **通过 xmlns 引入约束文件的名称空间**

-3. 给某一个 xmlns 属性添加一个标识,用于区分不同的名称空间,格式为 `xmlns:标识="名称空间url"` ,标识可以是任意的,但是一般取值都是 xsi

-4. 通过 xsi:schemaLocation 指定名称空间所对应的约束文件路径,格式为 `xsi:schemaLocation = "名称空间url 文件路径`

-

-```scheme

-

-

- xmlns="http://www.seazean.cn/javase"

- xsi:schemaLocation="http://www.seazean.cn/javase person.xsd"

->

-

-

- 张三

- 23

-

-

-

-```

-

-

-

-****

-

-

-

-##### XSD 属性

-

-```scheme

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

-

- 张三

- 23

-

-

-

-```

-

***

@@ -9256,7 +8985,7 @@ public class Dom4JDemo {

JavaWeb开发教程

- 张孝祥

+ 张三

100.00元

@@ -9390,8 +9119,6 @@ public class Dom4JDemo {

System.out.println(bookEle.elementTextTrim("name")); // 去前后空格

System.out.println(bookEle.elementText("author"));

System.out.println(bookEle.elementTextTrim("author")); // 去前后空格

- System.out.println(bookEle.elementText("sale"));

- System.out.println(bookEle.elementTextTrim("sale")); // 去前后空格

// 6.先获取到子元素对象,再获取该文本值

Element bookNameEle = bookEle.element("name");

@@ -10596,23 +10323,26 @@ Return Address:存放调用该方法的 PC 寄存器的值

本地方法栈是为虚拟机执行本地方法时提供服务的

-JNI:Java Native Interface,通过使用 Java 本地接口书写程序,可以确保代码在不同的平台上方便移植

+JNI:Java Native Interface,通过使用 Java 本地接口程序,可以确保代码在不同的平台上方便移植

* 不需要进行 GC,与虚拟机栈类似,也是线程私有的,有 StackOverFlowError 和 OutOfMemoryError 异常

-

* 虚拟机栈执行的是 Java 方法,在 HotSpot JVM 中,直接将本地方法栈和虚拟机栈合二为一

-

* 本地方法一般是由其他语言编写,并且被编译为基于本机硬件和操作系统的程序

-

* 当某个线程调用一个本地方法时,就进入了不再受虚拟机限制的世界,和虚拟机拥有同样的权限

* 本地方法可以通过本地方法接口来**访问虚拟机内部的运行时数据区**

* 直接从本地内存的堆中分配任意数量的内存

* 可以直接使用本地处理器中的寄存器

-  -

-

+

+原理:将本地的 C 函数(如 foo)编译到一个共享库(foo.so)中,当正在运行的 Java 程序调用 foo 时,Java 解释器利用 dlopen 接口动态链接和加载 foo.so 后再调用该函数

+

+* dlopen 函数:Linux 系统加载和链接共享库

+* dlclose 函数:卸载共享库

+

+

-

-

+

+原理:将本地的 C 函数(如 foo)编译到一个共享库(foo.so)中,当正在运行的 Java 程序调用 foo 时,Java 解释器利用 dlopen 接口动态链接和加载 foo.so 后再调用该函数

+

+* dlopen 函数:Linux 系统加载和链接共享库

+* dlclose 函数:卸载共享库

+

+ +

+

图片来源:https://github.com/CyC2018/CS-Notes/blob/master/notes/Java%20%E8%99%9A%E6%8B%9F%E6%9C%BA.md

@@ -11494,7 +11224,7 @@ Java 语言提供了对象终止(finalization)机制来允许开发人员提

- 主要不足是**只使用了内存的一半**

- 对于 G1 这种分拆成为大量 region 的 GC,复制而不是移动,意味着 GC 需要维护 region 之间对象引用关系,不管是内存占用或者时间开销都不小

-现在的商业虚拟机都采用这种收集算法**回收新生代**,但是并不是划分为大小相等的两块,而是一块较大的 Eden 空间和两块较小的 Survivor 空间

+现在的商业虚拟机都采用这种收集算法**回收新生代**,因为新生代 GC 频繁并且对象的存活率不高,但是并不是划分为大小相等的两块,而是一块较大的 Eden 空间和两块较小的 Survivor 空间

@@ -11710,7 +11440,7 @@ CMS 收集器的关注点是尽可能缩短垃圾收集时用户线程的停顿

- 初始标记:使用 STW 出现短暂停顿,仅标记一下 GC Roots 能直接关联到的对象,速度很快

- 并发标记:进行 GC Roots 开始遍历整个对象图,在整个回收过程中耗时最长,不需要 STW,可以与用户线程并发运行

-- 重新标记:修正并发标记期间因用户程序继续运作而导致标记产生变动的那一部分对象的标记记录,比初始标记时间长但远比并发标记时间短,需要 STW(不停顿就会一直变化,采用写屏障 + 增量更新来避免漏标情况)

+- 重新标记:修正并发标记期间因用户程序继续运作而导致标记产生变动的那一部分对象,比初始标记时间长但远比并发标记时间短,需要 STW(不停顿就会一直变化,采用写屏障 + 增量更新来避免漏标情况)

- 并发清除:清除标记为可以回收对象,**不需要移动存活对象**,所以这个阶段可以与用户线程同时并发的

Mark Sweep 会造成内存碎片,不把算法换成 Mark Compact 的原因:Mark Compact 算法会整理内存,导致用户线程使用的**对象的地址改变**,影响用户线程继续执行

@@ -11782,7 +11512,7 @@ G1 对比其他处理器的优点:

- 空间整合:

- CMS:标记-清除算法、内存碎片、若干次 GC 后进行一次碎片整理

- - G1:整体来看是基于标记 - 整理算法实现的收集器,从局部(Region 之间)上来看是基于复制算法实现的,两种算法都可以避免内存碎片

+ - G1:整体来看是**基于标记 - 整理算法实现**的收集器,从局部(Region 之间)上来看是基于复制算法实现的,两种算法都可以避免内存碎片

- **可预测的停顿时间模型(软实时 soft real-time)**:可以指定在 M 毫秒的时间片段内,消耗在 GC 上的时间不得超过 N 毫秒

@@ -12541,7 +12271,7 @@ Java 对象创建时机:

- 通过类的完全限定名称获取定义该类的二进制字节流(二进制字节码)

- 将该字节流表示的静态存储结构转换为方法区的运行时存储结构(Java 类模型)

-- **在内存中生成一个代表该类的 Class 对象,作为该类在方法区中的各种数据的访问入口**

+- **将字节码文件加载至方法区后,在堆中生成一个代表该类的 Class 对象,作为该类在方法区中的各种数据的访问入口**

其中二进制字节流可以从以下方式中获取:

@@ -12550,8 +12280,6 @@ Java 对象创建时机:

- 由其他文件生成,例如由 JSP 文件生成对应的 Class 类

- 运行时计算生成,例如动态代理技术,在 java.lang.reflect.Proxy 使用 ProxyGenerator.generateProxyClass 生成字节码

-将字节码文件加载至方法区后,会**在堆中**创建一个 java.lang.Class 对象,用来引用位于方法区内的数据结构,该 Class 对象是在加载类的过程中创建的,每个类都对应有一个 Class 类型的对象

-

方法区内部采用 C++ 的 instanceKlass 描述 Java 类的数据结构:

* `_java_mirror` 即 Java 的类镜像,例如对 String 来说就是 String.class,作用是把 class 暴露给 Java 使用

@@ -12638,7 +12366,7 @@ Java 对象创建时机:

public static final int value = 123;

```

-* Java 并不支持 boolean 类型,对于 boolean 类型,内部实现是 int,由于 int 的默认值是0,故 boolean 的默认值就是 false

+* Java 并不支持 boolean 类型,对于 boolean 类型,内部实现是 int,由于 int 的默认值是 0,故 boolean 的默认值就是 false

@@ -12791,7 +12519,7 @@ new 关键字会创建对象并复制 dup 一个对象引用,一个调用 loadClass(String name, boolean resolve)

* 如果不想破坏双亲委派模型,只需要重写 findClass 方法

* 如果想要去破坏双亲委派模型,需要去**重写 loadClass **方法

-* 引入线程**上下文类加载器**

+* 引入**线程上下文类加载器**

- Java 提供了很多服务提供者接口(Service Provider Interface,SPI),允许第三方为这些接口提供实现。常见的 SPI 有 JDBC、JCE、JNDI 等。这些 SPI 接口由 Java 核心库来提供,而 SPI 的实现代码则是作为 Java 应用所依赖的 jar 包被包含进类路径 classpath 里,SPI 接口中的代码需要加载具体的实现类:

+ Java 提供了很多服务提供者接口(Service Provider Interface,SPI),允许第三方为这些接口提供实现。常见的有 JDBC、JCE、JNDI 等。这些 SPI 接口由 Java 核心库来提供,而 SPI 的实现代码则是作为 Java 应用所依赖的 jar 包被包含进类路径 classpath 里,SPI 接口中的代码需要加载具体的实现类:

* SPI 的接口是 Java 核心库的一部分,是由引导类加载器来加载的

* SPI 的实现类是由系统类加载器加载,引导类加载器是无法找到 SPI 的实现类,因为双亲委派模型中 BootstrapClassloader 无法委派 AppClassLoader 来加载类

@@ -14468,14 +14196,9 @@ public static int invoke(Object... args) {

在 JVM 中,将符号引用转换为直接引用有两种机制:

- 静态链接:当一个字节码文件被装载进 JVM 内部时,如果被调用的目标方法在编译期可知,且运行期保持不变,将调用方法的符号引用转换为直接引用的过程称之为静态链接(类加载的解析阶段)

-- 动态链接:如果被调用的方法在编译期无法被确定下来,只能够在程序运行期将调用方法的符号引用转换为直接引用,由于这种引用转换过程具备动态性,因此被称为动态链接(初始化后的解析阶段)

-

-对应方法的绑定(分配)机制:静态绑定和动态绑定。绑定是一个字段、方法或者类从符号引用被替换为直接引用的过程,仅发生一次:

-

-- 静态绑定:被调用的目标方法在编译期可知,且运行期保持不变,将这个方法与所属的类型进行绑定

-- 动态绑定:被调用的目标方法在编译期无法确定,只能在程序运行期根据实际的类型绑定相关的方法

+- 动态链接:被调用的方法在编译期无法被确定下来,只能在程序运行期将调用方法的符号引用转换为直接引用,由于这种引用转换过程具备动态性,因此被称为动态链接(初始化后的解析阶段)

-* Java 编译器已经区分了重载的方法(静态绑定和动态绑定),因此可以认为虚拟机中不存在重载

+* 对应方法的绑定(分配)机制:静态绑定和动态绑定,编译器已经区分了重载的方法(静态绑定和动态绑定),因此可以认为虚拟机中不存在重载

非虚方法:

@@ -14509,7 +14232,7 @@ public static int invoke(Object... args) {

普通调用指令:

- invokestatic:调用静态方法

-- invokespecial:调用私有实例方法、构造器,和父类的实例方法或构造器,以及所实现接口的默认方法

+- invokespecial:调用私有方法、构造器,和父类的实例方法或构造器,以及所实现接口的默认方法

- invokevirtual:调用所有虚方法(虚方法分派)

- invokeinterface:调用接口方法

@@ -14541,9 +14264,6 @@ public static int invoke(Object... args) {

在编译过程中,虚拟机并不知道目标方法的具体内存地址,Java 编译器会暂时用符号引用来表示该目标方法,这一符号引用包括目标方法所在的类或接口的名字,以及目标方法的方法名和方法描述符

-* 对于静态绑定的方法调用而言,实际引用是一个指向方法的指针

-* 对于需要动态绑定的方法调用而言,实际引用则是一个方法表的索引

-

符号引用存储在方法区常量池中,根据目标方法是否为接口方法,分为接口符号引用和非接口符号引用:

```java

@@ -14645,8 +14365,6 @@ Java 虚拟机中关于方法重写的判定基于方法描述符,如果子类

2. 如果在类型 C 中找到与描述符和名称都相符的方法,则进行访问**权限校验**(私有的),如果通过则返回这个方法的直接引用,查找过程结束;如果不通过,则返回 java.lang.IllegalAccessError 异常

- IllegalAccessError:表示程序试图访问或修改一个属性或调用一个方法,这个属性或方法没有权限访问,一般会引起编译器异常。如果这个错误发生在运行时,就说明一个类发生了不兼容的改变

-

3. 找不到,就会按照继承关系从下往上依次对 C 的各个父类进行第二步的搜索和验证过程

4. 如果始终没有找到合适的方法,则抛出 java.lang.AbstractMethodError 异常

@@ -14670,15 +14388,15 @@ Java 虚拟机中关于方法重写的判定基于方法描述符,如果子类

虚方法表的执行过程:

-* 对于静态绑定的方法调用而言,实际引用将指向具体的目标方法

-* 对于动态绑定的方法调用而言,实际引用则是方法表的索引值,也就是方法的间接地址。Java 虚拟机获取调用者的实际类型,并在该实际类型的虚方法表中,根据索引值获得目标方法内存偏移量(指针)

+* 对于静态绑定的方法调用而言,实际引用是一个指向方法的指针

+* 对于动态绑定的方法调用而言,实际引用是方法表的索引值,也就是方法的间接地址。Java 虚拟机获取调用者的实际类型,并在该实际类型的虚方法表中,根据索引值获得目标方法内存偏移量(指针)

为了优化对象调用方法的速度,方法区的类型信息会增加一个指针,该指针指向一个记录该类方法的方法表。每个类中都有一个虚方法表,本质上是一个数组,每个数组元素指向一个当前类及其祖先类中非私有的实例方法

方法表满足以下的特质:

* 其一,子类方法表中包含父类方法表中的**所有方法**,并且在方法表中的索引值与父类方法表种的索引值相同

-* 其二,**非重写的方法指向父类的方法表项,与父类共享一个方法表项,重写的方法指向本身自己的实现**。所以这就是为什么多态情况下可以访问父类的方法。

+* 其二,**非重写的方法指向父类的方法表项,与父类共享一个方法表项,重写的方法指向本身自己的实现**,这就是为什么多态情况下可以访问父类的方法。

+

+

图片来源:https://github.com/CyC2018/CS-Notes/blob/master/notes/Java%20%E8%99%9A%E6%8B%9F%E6%9C%BA.md

@@ -11494,7 +11224,7 @@ Java 语言提供了对象终止(finalization)机制来允许开发人员提

- 主要不足是**只使用了内存的一半**

- 对于 G1 这种分拆成为大量 region 的 GC,复制而不是移动,意味着 GC 需要维护 region 之间对象引用关系,不管是内存占用或者时间开销都不小

-现在的商业虚拟机都采用这种收集算法**回收新生代**,但是并不是划分为大小相等的两块,而是一块较大的 Eden 空间和两块较小的 Survivor 空间

+现在的商业虚拟机都采用这种收集算法**回收新生代**,因为新生代 GC 频繁并且对象的存活率不高,但是并不是划分为大小相等的两块,而是一块较大的 Eden 空间和两块较小的 Survivor 空间

@@ -11710,7 +11440,7 @@ CMS 收集器的关注点是尽可能缩短垃圾收集时用户线程的停顿

- 初始标记:使用 STW 出现短暂停顿,仅标记一下 GC Roots 能直接关联到的对象,速度很快

- 并发标记:进行 GC Roots 开始遍历整个对象图,在整个回收过程中耗时最长,不需要 STW,可以与用户线程并发运行

-- 重新标记:修正并发标记期间因用户程序继续运作而导致标记产生变动的那一部分对象的标记记录,比初始标记时间长但远比并发标记时间短,需要 STW(不停顿就会一直变化,采用写屏障 + 增量更新来避免漏标情况)

+- 重新标记:修正并发标记期间因用户程序继续运作而导致标记产生变动的那一部分对象,比初始标记时间长但远比并发标记时间短,需要 STW(不停顿就会一直变化,采用写屏障 + 增量更新来避免漏标情况)

- 并发清除:清除标记为可以回收对象,**不需要移动存活对象**,所以这个阶段可以与用户线程同时并发的

Mark Sweep 会造成内存碎片,不把算法换成 Mark Compact 的原因:Mark Compact 算法会整理内存,导致用户线程使用的**对象的地址改变**,影响用户线程继续执行

@@ -11782,7 +11512,7 @@ G1 对比其他处理器的优点:

- 空间整合:

- CMS:标记-清除算法、内存碎片、若干次 GC 后进行一次碎片整理

- - G1:整体来看是基于标记 - 整理算法实现的收集器,从局部(Region 之间)上来看是基于复制算法实现的,两种算法都可以避免内存碎片

+ - G1:整体来看是**基于标记 - 整理算法实现**的收集器,从局部(Region 之间)上来看是基于复制算法实现的,两种算法都可以避免内存碎片

- **可预测的停顿时间模型(软实时 soft real-time)**:可以指定在 M 毫秒的时间片段内,消耗在 GC 上的时间不得超过 N 毫秒

@@ -12541,7 +12271,7 @@ Java 对象创建时机:

- 通过类的完全限定名称获取定义该类的二进制字节流(二进制字节码)

- 将该字节流表示的静态存储结构转换为方法区的运行时存储结构(Java 类模型)

-- **在内存中生成一个代表该类的 Class 对象,作为该类在方法区中的各种数据的访问入口**

+- **将字节码文件加载至方法区后,在堆中生成一个代表该类的 Class 对象,作为该类在方法区中的各种数据的访问入口**

其中二进制字节流可以从以下方式中获取:

@@ -12550,8 +12280,6 @@ Java 对象创建时机:

- 由其他文件生成,例如由 JSP 文件生成对应的 Class 类

- 运行时计算生成,例如动态代理技术,在 java.lang.reflect.Proxy 使用 ProxyGenerator.generateProxyClass 生成字节码

-将字节码文件加载至方法区后,会**在堆中**创建一个 java.lang.Class 对象,用来引用位于方法区内的数据结构,该 Class 对象是在加载类的过程中创建的,每个类都对应有一个 Class 类型的对象

-

方法区内部采用 C++ 的 instanceKlass 描述 Java 类的数据结构:

* `_java_mirror` 即 Java 的类镜像,例如对 String 来说就是 String.class,作用是把 class 暴露给 Java 使用

@@ -12638,7 +12366,7 @@ Java 对象创建时机:

public static final int value = 123;

```

-* Java 并不支持 boolean 类型,对于 boolean 类型,内部实现是 int,由于 int 的默认值是0,故 boolean 的默认值就是 false

+* Java 并不支持 boolean 类型,对于 boolean 类型,内部实现是 int,由于 int 的默认值是 0,故 boolean 的默认值就是 false

@@ -12791,7 +12519,7 @@ new 关键字会创建对象并复制 dup 一个对象引用,一个调用 loadClass(String name, boolean resolve)

* 如果不想破坏双亲委派模型,只需要重写 findClass 方法

* 如果想要去破坏双亲委派模型,需要去**重写 loadClass **方法

-* 引入线程**上下文类加载器**

+* 引入**线程上下文类加载器**

- Java 提供了很多服务提供者接口(Service Provider Interface,SPI),允许第三方为这些接口提供实现。常见的 SPI 有 JDBC、JCE、JNDI 等。这些 SPI 接口由 Java 核心库来提供,而 SPI 的实现代码则是作为 Java 应用所依赖的 jar 包被包含进类路径 classpath 里,SPI 接口中的代码需要加载具体的实现类:

+ Java 提供了很多服务提供者接口(Service Provider Interface,SPI),允许第三方为这些接口提供实现。常见的有 JDBC、JCE、JNDI 等。这些 SPI 接口由 Java 核心库来提供,而 SPI 的实现代码则是作为 Java 应用所依赖的 jar 包被包含进类路径 classpath 里,SPI 接口中的代码需要加载具体的实现类:

* SPI 的接口是 Java 核心库的一部分,是由引导类加载器来加载的

* SPI 的实现类是由系统类加载器加载,引导类加载器是无法找到 SPI 的实现类,因为双亲委派模型中 BootstrapClassloader 无法委派 AppClassLoader 来加载类

@@ -14468,14 +14196,9 @@ public static int invoke(Object... args) {

在 JVM 中,将符号引用转换为直接引用有两种机制:

- 静态链接:当一个字节码文件被装载进 JVM 内部时,如果被调用的目标方法在编译期可知,且运行期保持不变,将调用方法的符号引用转换为直接引用的过程称之为静态链接(类加载的解析阶段)

-- 动态链接:如果被调用的方法在编译期无法被确定下来,只能够在程序运行期将调用方法的符号引用转换为直接引用,由于这种引用转换过程具备动态性,因此被称为动态链接(初始化后的解析阶段)

-

-对应方法的绑定(分配)机制:静态绑定和动态绑定。绑定是一个字段、方法或者类从符号引用被替换为直接引用的过程,仅发生一次:

-

-- 静态绑定:被调用的目标方法在编译期可知,且运行期保持不变,将这个方法与所属的类型进行绑定

-- 动态绑定:被调用的目标方法在编译期无法确定,只能在程序运行期根据实际的类型绑定相关的方法

+- 动态链接:被调用的方法在编译期无法被确定下来,只能在程序运行期将调用方法的符号引用转换为直接引用,由于这种引用转换过程具备动态性,因此被称为动态链接(初始化后的解析阶段)

-* Java 编译器已经区分了重载的方法(静态绑定和动态绑定),因此可以认为虚拟机中不存在重载

+* 对应方法的绑定(分配)机制:静态绑定和动态绑定,编译器已经区分了重载的方法(静态绑定和动态绑定),因此可以认为虚拟机中不存在重载

非虚方法:

@@ -14509,7 +14232,7 @@ public static int invoke(Object... args) {

普通调用指令:

- invokestatic:调用静态方法

-- invokespecial:调用私有实例方法、构造器,和父类的实例方法或构造器,以及所实现接口的默认方法

+- invokespecial:调用私有方法、构造器,和父类的实例方法或构造器,以及所实现接口的默认方法

- invokevirtual:调用所有虚方法(虚方法分派)

- invokeinterface:调用接口方法

@@ -14541,9 +14264,6 @@ public static int invoke(Object... args) {

在编译过程中,虚拟机并不知道目标方法的具体内存地址,Java 编译器会暂时用符号引用来表示该目标方法,这一符号引用包括目标方法所在的类或接口的名字,以及目标方法的方法名和方法描述符

-* 对于静态绑定的方法调用而言,实际引用是一个指向方法的指针

-* 对于需要动态绑定的方法调用而言,实际引用则是一个方法表的索引

-

符号引用存储在方法区常量池中,根据目标方法是否为接口方法,分为接口符号引用和非接口符号引用:

```java

@@ -14645,8 +14365,6 @@ Java 虚拟机中关于方法重写的判定基于方法描述符,如果子类

2. 如果在类型 C 中找到与描述符和名称都相符的方法,则进行访问**权限校验**(私有的),如果通过则返回这个方法的直接引用,查找过程结束;如果不通过,则返回 java.lang.IllegalAccessError 异常

- IllegalAccessError:表示程序试图访问或修改一个属性或调用一个方法,这个属性或方法没有权限访问,一般会引起编译器异常。如果这个错误发生在运行时,就说明一个类发生了不兼容的改变

-

3. 找不到,就会按照继承关系从下往上依次对 C 的各个父类进行第二步的搜索和验证过程

4. 如果始终没有找到合适的方法,则抛出 java.lang.AbstractMethodError 异常

@@ -14670,15 +14388,15 @@ Java 虚拟机中关于方法重写的判定基于方法描述符,如果子类

虚方法表的执行过程:

-* 对于静态绑定的方法调用而言,实际引用将指向具体的目标方法

-* 对于动态绑定的方法调用而言,实际引用则是方法表的索引值,也就是方法的间接地址。Java 虚拟机获取调用者的实际类型,并在该实际类型的虚方法表中,根据索引值获得目标方法内存偏移量(指针)

+* 对于静态绑定的方法调用而言,实际引用是一个指向方法的指针

+* 对于动态绑定的方法调用而言,实际引用是方法表的索引值,也就是方法的间接地址。Java 虚拟机获取调用者的实际类型,并在该实际类型的虚方法表中,根据索引值获得目标方法内存偏移量(指针)

为了优化对象调用方法的速度,方法区的类型信息会增加一个指针,该指针指向一个记录该类方法的方法表。每个类中都有一个虚方法表,本质上是一个数组,每个数组元素指向一个当前类及其祖先类中非私有的实例方法

方法表满足以下的特质:

* 其一,子类方法表中包含父类方法表中的**所有方法**,并且在方法表中的索引值与父类方法表种的索引值相同

-* 其二,**非重写的方法指向父类的方法表项,与父类共享一个方法表项,重写的方法指向本身自己的实现**。所以这就是为什么多态情况下可以访问父类的方法。

+* 其二,**非重写的方法指向父类的方法表项,与父类共享一个方法表项,重写的方法指向本身自己的实现**,这就是为什么多态情况下可以访问父类的方法。

diff --git a/Prog.md b/Prog.md

index c0a54d0..2aee6d0 100644

--- a/Prog.md

+++ b/Prog.md

@@ -1505,7 +1505,7 @@ Object 类 API:

```java

public final void notify():唤醒正在等待对象监视器的单个线程。

public final void notifyAll():唤醒正在等待对象监视器的所有线程。

-public final void wait():导致当前线程等待,直到另一个线程调用该对象的notify()方法或 notifyAll()方法。

+public final void wait():导致当前线程等待,直到另一个线程调用该对象的 notify() 方法或 notifyAll()方法。

public final native void wait(long timeout):有时限的等待, 到n毫秒后结束等待,或是被唤醒

```

@@ -2539,9 +2539,7 @@ volatile 修饰的变量,可以禁用指令重排

##### 缓存一致

-使用 volatile 修饰的共享变量,总线会开启 **CPU 总线嗅探机制**来解决 JMM 缓存一致性问题,也就是共享变量在多线程中可见性的问题,实现 MESI 缓存一致性协议

-

-底层是通过汇编 lock 前缀指令,共享变量加了 lock 前缀指令就会进行缓存锁定,在线程修改完共享变量后写回主存,其他的 CPU 核心上运行的线程根据总线嗅探机制会修改其共享变量为失效状态,读取时会重新从主内存中读取最新的数据

+使用 volatile 修饰的共享变量,底层通过汇编 lock 前缀指令进行缓存锁定,在线程修改完共享变量后写回主存,其他的 CPU 核心上运行的线程通过 CPU 总线嗅探机制会修改其共享变量为失效状态,读取时会重新从主内存中读取最新的数据

lock 前缀指令就相当于内存屏障,Memory Barrier(Memory Fence)

@@ -2921,7 +2919,7 @@ CAS 特点:

CAS 缺点:

-- 循环时间长,开销大,因为执行的是循环操作,如果比较不成功一直在循环,最差的情况某个线程一直取到的值和预期值都不一样,就会无限循环导致饥饿,**使用 CAS 线程数不要超过 CPU 的核心数**

+- 执行的是循环操作,如果比较不成功一直在循环,最差的情况某个线程一直取到的值和预期值都不一样,就会无限循环导致饥饿,**使用 CAS 线程数不要超过 CPU 的核心数**,采用分段 CAS 和自动迁移机制

- 只能保证一个共享变量的原子操作

- 对于一个共享变量执行操作时,可以通过循环 CAS 的方式来保证原子操作

- 对于多个共享变量操作时,循环 CAS 就无法保证操作的原子性,这个时候**只能用锁来保证原子性**

@@ -3470,7 +3468,7 @@ ABA 问题:当进行获取主内存值时,该内存值在写入主内存时

* `public AtomicStampedReference(V initialRef, int initialStamp)`:初始值和初始版本号

* 常用API:

- * ` public boolean compareAndSet(V expectedReference, V newReference, int expectedStamp, int newStamp)`:期望引用和期望版本号都一致才进行 CAS 修改数据

+ * ` public boolean compareAndSet(V expectedReference, V newReference, int expectedStamp, int newStamp)`:**期望引用和期望版本号都一致**才进行 CAS 修改数据

* `public void set(V newReference, int newStamp)`:设置值和版本号

* `public V getReference()`:返回引用的值

* `public int getStamp()`:返回当前版本号

@@ -3595,7 +3593,10 @@ public class TestFinal {

final 变量的赋值通过 putfield 指令来完成,在这条指令之后也会加入写屏障,保证在其它线程读到它的值时不会出现为 0 的情况

-其他线程访问 final 修饰的变量**会复制一份放入栈中**,效率更高

+其他线程访问 final 修饰的变量

+

+* **复制一份放入栈中**直接访问,效率高

+* 大于 short 最大值会将其复制到类的常量池,访问时从常量池获取

@@ -4424,9 +4425,9 @@ ThreadLocal 内部解决方法:在 ThreadLocalMap 中的 set/getEntry 方法

##### 基本使用

-父子线程:**创建子线程的线程是父线程**,比如实例中的 main 线程就是父线程

+父子线程:创建子线程的线程是父线程,比如实例中的 main 线程就是父线程

-ThreadLocal 中存储的是线程的局部变量,如果想实现线程间局部变量传递可以使用 InheritableThreadLocal 类

+ThreadLocal 中存储的是线程的局部变量,如果想**实现线程间局部变量传递**可以使用 InheritableThreadLocal 类

```java

public static void main(String[] args) {

@@ -5650,7 +5651,7 @@ ExecutorService 类 API:

| 方法 | 说明 |

| ----------------------------------------------------- | ------------------------------------------------------------ |

-| void shutdown() | 线程池状态变为 SHUTDOWN,等待任务执行完后关闭线程池,不会接收新任务,但已提交任务会执行完,而且也可以添加线程(不绑定ren'wu) |

+| void shutdown() | 线程池状态变为 SHUTDOWN,等待任务执行完后关闭线程池,不会接收新任务,但已提交任务会执行完,而且也可以添加线程(不绑定任务) |

| List shutdownNow() | 线程池状态变为 STOP,用 interrupt 中断正在执行的任务,直接关闭线程池,不会接收新任务,会将队列中的任务返回 |

| boolean isShutdown() | 不在 RUNNING 状态的线程池,此执行者已被关闭,方法返回 true |

| boolean isTerminated() | 线程池状态是否是 TERMINATED,如果所有任务在关闭后完成,返回 true |

@@ -8251,7 +8252,7 @@ public void lock() {

}

```

-* 接下来进入 addWaiter 逻辑,构造 Node 队列,前置条件是当前线程获取锁失败,说明有线程占用了锁

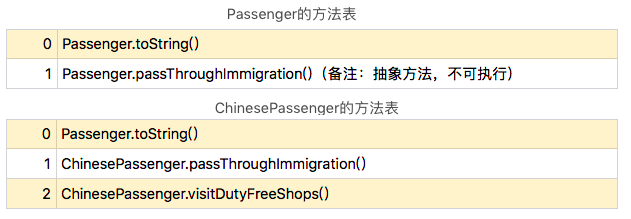

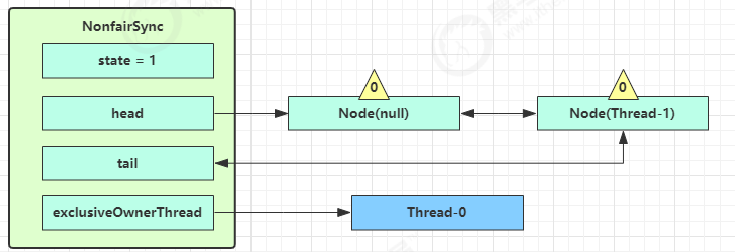

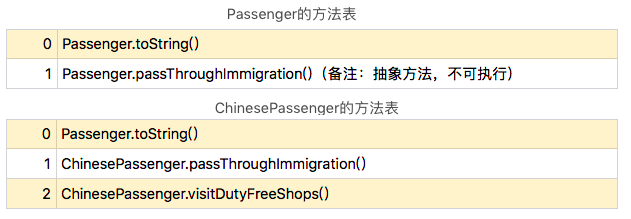

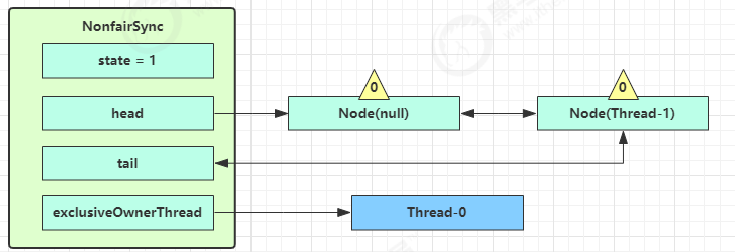

+* 接下来进入 addWaiter 逻辑,构造 Node 队列(不是阻塞队列),前置条件是当前线程获取锁失败,说明有线程占用了锁

* 图中黄色三角表示该 Node 的 waitStatus 状态,其中 0 为默认**正常状态**

* Node 的创建是懒惰的,其中第一个 Node 称为 **Dummy(哑元)或哨兵**,用来占位,并不关联线程

@@ -8262,7 +8263,7 @@ public void lock() {

// 将当前线程关联到一个 Node 对象上, 模式为独占模式

Node node = new Node(Thread.currentThread(), mode);

Node pred = tail;

- // 快速入队,如果 tail 不为 null,说明存在阻塞队列

+ // 快速入队,如果 tail 不为 null,说明存在队列

if (pred != null) {

// 将当前节点的前驱节点指向 尾节点

node.prev = pred;

@@ -8305,7 +8306,7 @@ public void lock() {

diff --git a/Prog.md b/Prog.md

index c0a54d0..2aee6d0 100644

--- a/Prog.md

+++ b/Prog.md

@@ -1505,7 +1505,7 @@ Object 类 API:

```java

public final void notify():唤醒正在等待对象监视器的单个线程。

public final void notifyAll():唤醒正在等待对象监视器的所有线程。

-public final void wait():导致当前线程等待,直到另一个线程调用该对象的notify()方法或 notifyAll()方法。

+public final void wait():导致当前线程等待,直到另一个线程调用该对象的 notify() 方法或 notifyAll()方法。

public final native void wait(long timeout):有时限的等待, 到n毫秒后结束等待,或是被唤醒

```

@@ -2539,9 +2539,7 @@ volatile 修饰的变量,可以禁用指令重排

##### 缓存一致

-使用 volatile 修饰的共享变量,总线会开启 **CPU 总线嗅探机制**来解决 JMM 缓存一致性问题,也就是共享变量在多线程中可见性的问题,实现 MESI 缓存一致性协议

-

-底层是通过汇编 lock 前缀指令,共享变量加了 lock 前缀指令就会进行缓存锁定,在线程修改完共享变量后写回主存,其他的 CPU 核心上运行的线程根据总线嗅探机制会修改其共享变量为失效状态,读取时会重新从主内存中读取最新的数据

+使用 volatile 修饰的共享变量,底层通过汇编 lock 前缀指令进行缓存锁定,在线程修改完共享变量后写回主存,其他的 CPU 核心上运行的线程通过 CPU 总线嗅探机制会修改其共享变量为失效状态,读取时会重新从主内存中读取最新的数据

lock 前缀指令就相当于内存屏障,Memory Barrier(Memory Fence)

@@ -2921,7 +2919,7 @@ CAS 特点:

CAS 缺点:

-- 循环时间长,开销大,因为执行的是循环操作,如果比较不成功一直在循环,最差的情况某个线程一直取到的值和预期值都不一样,就会无限循环导致饥饿,**使用 CAS 线程数不要超过 CPU 的核心数**

+- 执行的是循环操作,如果比较不成功一直在循环,最差的情况某个线程一直取到的值和预期值都不一样,就会无限循环导致饥饿,**使用 CAS 线程数不要超过 CPU 的核心数**,采用分段 CAS 和自动迁移机制

- 只能保证一个共享变量的原子操作

- 对于一个共享变量执行操作时,可以通过循环 CAS 的方式来保证原子操作

- 对于多个共享变量操作时,循环 CAS 就无法保证操作的原子性,这个时候**只能用锁来保证原子性**

@@ -3470,7 +3468,7 @@ ABA 问题:当进行获取主内存值时,该内存值在写入主内存时

* `public AtomicStampedReference(V initialRef, int initialStamp)`:初始值和初始版本号

* 常用API:

- * ` public boolean compareAndSet(V expectedReference, V newReference, int expectedStamp, int newStamp)`:期望引用和期望版本号都一致才进行 CAS 修改数据

+ * ` public boolean compareAndSet(V expectedReference, V newReference, int expectedStamp, int newStamp)`:**期望引用和期望版本号都一致**才进行 CAS 修改数据

* `public void set(V newReference, int newStamp)`:设置值和版本号

* `public V getReference()`:返回引用的值

* `public int getStamp()`:返回当前版本号

@@ -3595,7 +3593,10 @@ public class TestFinal {

final 变量的赋值通过 putfield 指令来完成,在这条指令之后也会加入写屏障,保证在其它线程读到它的值时不会出现为 0 的情况

-其他线程访问 final 修饰的变量**会复制一份放入栈中**,效率更高

+其他线程访问 final 修饰的变量

+

+* **复制一份放入栈中**直接访问,效率高

+* 大于 short 最大值会将其复制到类的常量池,访问时从常量池获取

@@ -4424,9 +4425,9 @@ ThreadLocal 内部解决方法:在 ThreadLocalMap 中的 set/getEntry 方法

##### 基本使用

-父子线程:**创建子线程的线程是父线程**,比如实例中的 main 线程就是父线程

+父子线程:创建子线程的线程是父线程,比如实例中的 main 线程就是父线程

-ThreadLocal 中存储的是线程的局部变量,如果想实现线程间局部变量传递可以使用 InheritableThreadLocal 类

+ThreadLocal 中存储的是线程的局部变量,如果想**实现线程间局部变量传递**可以使用 InheritableThreadLocal 类

```java

public static void main(String[] args) {

@@ -5650,7 +5651,7 @@ ExecutorService 类 API:

| 方法 | 说明 |

| ----------------------------------------------------- | ------------------------------------------------------------ |

-| void shutdown() | 线程池状态变为 SHUTDOWN,等待任务执行完后关闭线程池,不会接收新任务,但已提交任务会执行完,而且也可以添加线程(不绑定ren'wu) |

+| void shutdown() | 线程池状态变为 SHUTDOWN,等待任务执行完后关闭线程池,不会接收新任务,但已提交任务会执行完,而且也可以添加线程(不绑定任务) |

| List shutdownNow() | 线程池状态变为 STOP,用 interrupt 中断正在执行的任务,直接关闭线程池,不会接收新任务,会将队列中的任务返回 |

| boolean isShutdown() | 不在 RUNNING 状态的线程池,此执行者已被关闭,方法返回 true |

| boolean isTerminated() | 线程池状态是否是 TERMINATED,如果所有任务在关闭后完成,返回 true |

@@ -8251,7 +8252,7 @@ public void lock() {

}

```

-* 接下来进入 addWaiter 逻辑,构造 Node 队列,前置条件是当前线程获取锁失败,说明有线程占用了锁

+* 接下来进入 addWaiter 逻辑,构造 Node 队列(不是阻塞队列),前置条件是当前线程获取锁失败,说明有线程占用了锁

* 图中黄色三角表示该 Node 的 waitStatus 状态,其中 0 为默认**正常状态**

* Node 的创建是懒惰的,其中第一个 Node 称为 **Dummy(哑元)或哨兵**,用来占位,并不关联线程

@@ -8262,7 +8263,7 @@ public void lock() {

// 将当前线程关联到一个 Node 对象上, 模式为独占模式

Node node = new Node(Thread.currentThread(), mode);

Node pred = tail;

- // 快速入队,如果 tail 不为 null,说明存在阻塞队列

+ // 快速入队,如果 tail 不为 null,说明存在队列

if (pred != null) {

// 将当前节点的前驱节点指向 尾节点

node.prev = pred;

@@ -8305,7 +8306,7 @@ public void lock() {

-* 线程节点加入阻塞队列成功,进入 AbstractQueuedSynchronizer#acquireQueued 逻辑阻塞线程

+* 线程节点加入队列成功,进入 AbstractQueuedSynchronizer#acquireQueued 逻辑阻塞线程

* acquireQueued 会在一个自旋中不断尝试获得锁,失败后进入 park 阻塞

@@ -10758,7 +10759,7 @@ public class ExchangerDemo {

// 创建交换对象(信使)

Exchanger exchanger = new Exchanger<>();

new ThreadA(exchanger).start();

- new ThreadA(exchanger).start();

+ new ThreadB(exchanger).start();

}

}

class ThreadA extends Thread{

diff --git a/README.md b/README.md

index 6083f8e..a013bf5 100644

--- a/README.md

+++ b/README.md

@@ -1,3 +1,15 @@

+## 组内直招

+

+阿里巴巴 AliExpress 营销团队:https://aidc-jobs.alibaba.com/off-campus/position-detail?lang=zh&positionId=1040520

+

+联系邮箱:xizan.zhy@alibaba-inc.com

+

+

+

+

+

+## 仓库介绍

+

**Java** 学习笔记,记录作者从编程入门到深入学习的所有知识,每次学有所获都会更新笔记,排版布局**美观整洁**,希望对各位读者朋友有所帮助。

个人邮箱:imseazean@gmail.com

@@ -8,7 +20,7 @@

* Frame:Maven、Netty、RocketMQ、Zookeeper

* Java:JavaSE、JVM、Algorithm

* Prog:Concurrent、Network Programming

-* SSM:MyBatis、Spring、SpringMVC、SpringBoot

+* SSM:MyBatis、Spring、SpringMVC、SpringBoot、SpringCloud

* Tool:Git、Linux、Docker

* Web:HTML、CSS、HTTP、Servlet、JavaScript

@@ -17,7 +29,3 @@

* 推荐使用 Typora 阅读笔记,打开目录栏效果更佳。

* 所有的知识不保证权威性,如果各位朋友发现错误,欢迎与我讨论。

* 笔记的编写基于 Windows 平台,可能会因为平台的不同而造成空格、制表符的显示效果不同。

-

-字节跳动校园招聘:https://jobs.bytedance.com/campus/invite?referral_code=1VQUWCD

-

-

diff --git a/SSM.md b/SSM.md

index 6939b15..60035dc 100644

--- a/SSM.md

+++ b/SSM.md

@@ -2878,39 +2878,6 @@ PageInfo相关API:

## 概述

-### 框架

-

-框架源自于建筑学,隶属土木工程,后发展到软件工程领域

-

-软件工程框架:经过验证的,具有一定功能的,半成品软件

-

-- 经过验证

-

-- 具有一定功能

-

-- 半成品

-

-框架作用:

-

-* 提高开发效率

-* 增强可重用性

-

-* 提供编写规范

-* 节约维护成本

-* 解耦底层实现原理

-

-

-

-参考视频:https://space.bilibili.com/37974444

-

-

-

-****

-

-

-

-### Spring

-

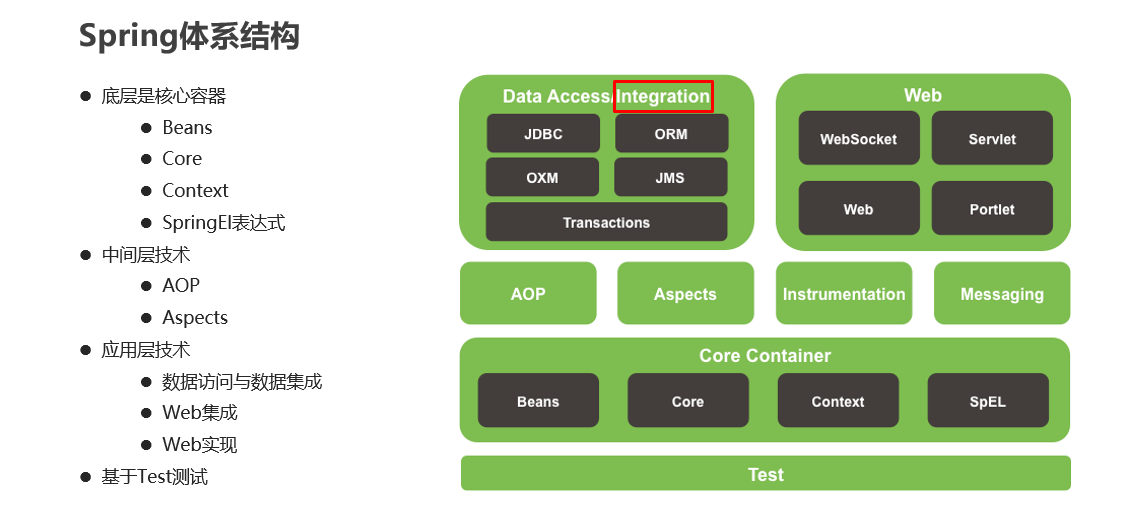

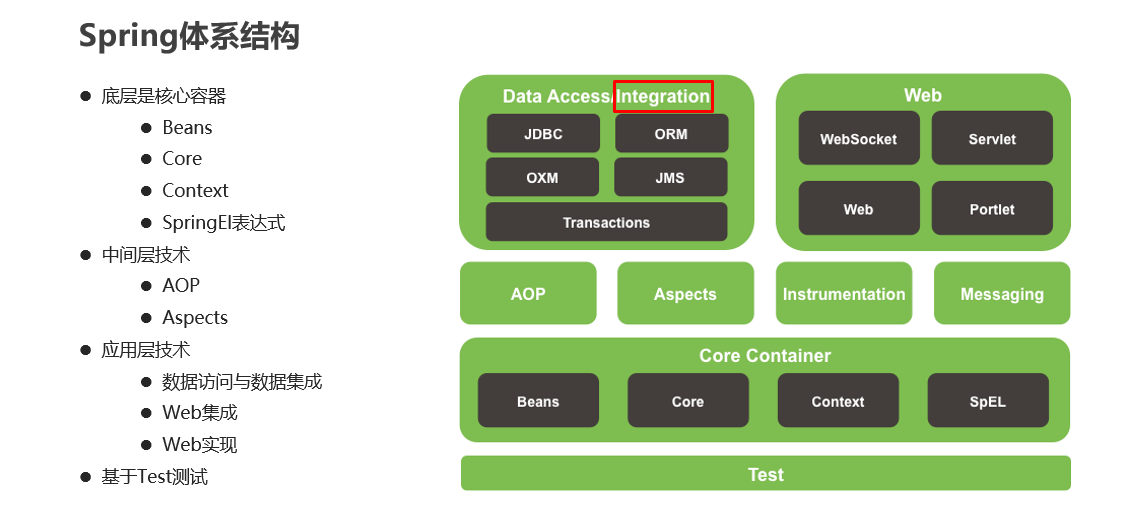

Spring 是分层的 JavaSE/EE 应用 full-stack 轻量级开源框架

@@ -2928,6 +2895,10 @@ Spring 优点:

+参考视频:https://space.bilibili.com/37974444

+

+

+

***

@@ -13890,7 +13861,7 @@ SpringBoot 功能:

1. 使用 @ComponentScan 扫描 com.example.config 包

-2. 使用 @Import 注解,加载类,这些类都会被 Spring 创建并放入 ioc 容器,默认组件的名字就是**全类名**

+2. 使用 @Import 注解加载类,这些类都会被 Spring 创建并放入 ioc 容器,默认组件的名字就是**全类名**

3. 对 @Import 注解进行封装

@@ -13982,14 +13953,14 @@ Condition 是 Spring4.0 后引入的条件化配置接口,通过实现 Conditi

ConditionContext 类API:

-| 方法 | 说明 |

-| --------------------------------------------------- | ----------------------------- |

-| ConfigurableListableBeanFactory getBeanFactory() | 获取到 IOC 使用的 beanfactory |

-| ClassLoader getClassLoader() | 获取类加载器 |

-| Environment getEnvironment() | 获取当前环境信息 |

-| BeanDefinitionRegistry getRegistry() | 获取到 bean 定义的注册类 |

+| 方法 | 说明 |

+| ------------------------------------------------- | ----------------------------- |

+| ConfigurableListableBeanFactory getBeanFactory() | 获取到 IOC 使用的 beanfactory |

+| ClassLoader getClassLoader() | 获取类加载器 |